Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

Utilização de redes neurais convolucionais para a detecção de objetos em

imagens aéreas adquiridas por drones

Use of convolutional neural networks to detect objects in aerial images acquired

by drones

DOI:10.34117/bjdv6n7-646

Recebimento dos originais: 03/06/2020 Aceitação para publicação: 24/07/2020

Gustavo Araújo Lima

Discente do curso de mestrado em Informática e Gestão do Conhecimento (PPGI) Instituição: Universidade Nove de Julho − UNINOVE

Endereço: Rua Vergueiro, 235/249 − Liberdade, São Paulo/SP, Brasil, CEP 01525-000 E-mail: gustavoaraujo59@hotmail.com

Daniel Trevisan Bravo

Egresso do curso de doutorado em Informática e Gestão do Conhecimento (PPGI) Instituição: Universidade Nove de Julho − UNINOVE

Endereço: Rua Vergueiro, 235/249 − Liberdade, São Paulo/SP, Brasil, CEP 01525-000 E-mail: danieltb3006@gmail.com

Sidnei Alves de Araújo

Docente do Programa de Pós-Graduação em Informática e Gestão do Conhecimento (PPGI) Instituição: Universidade Nove de Julho − UNINOVE

Endereço: Rua Vergueiro, 235/249 − Liberdade, São Paulo/SP, Brasil, CEP 01525-000 E-mail: saraujo@uni9.pro.br

RESUMO

A epidemia da dengue, do vírus Zika e de outras doenças causadas pelo mosquito Aedes aegypti vem preocupando muito as autoridades da área de saúde, não só no Brasil, mas no mundo todo. Paralelamente às campanhas de prevenção, vários esforços vêm sendo feitos para agilizar a busca por potenciais focos do mosquito transmissor. Um deles é o uso de drones para a captura de imagens aéreas em áreas urbanas com maior incidência da doença. A utilização de drones tem se mostrado uma excelente alternativa, já que eles dispõem de uma flexibilidade maior e um custo baixo, se comparados às aeronaves tripuladas usadas em tarefas de imageamento. Contudo, as imagens adquiridas por drones são normalmente analisadas de forma manual (visualmente), podendo demandar muito tempo dos agentes de saúde. Assim, a proposição de abordagens computacionais que permitam a análise automática de tais imagens ganha muita importância. Neste trabalho investigou-se o uso de uma rede neural convolucional (RNC) para detecção de caixas e outros tipos de reservatórios de água para uso doméstico (objetos-alvo), que aparecem com frequência em imagens aéreas de regiões periféricas, e que estão diretamente relacionados com focos do mosquito. A RNC foi treinada com 2.498 subimagens de 200×200 pixels extraídas manualmente de um conjunto de imagens adquiridas com o uso de um drone em regiões periféricas da cidade de São Paulo. Nos experimentos realizados, obteve-se uma acurácia de 93,37% na etapa de validação do treinamento e 79,74% de acertos na etapa de testes, indicando que a abordagem proposta é uma boa alternativa para solucionar o problema investigado.

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

Palavras-chave: Reconhecimento de objetos, Visão computacional, Redes neurais convolucionais,

Drone, Aedes aegypti.

ABSTRACT

The epidemic of dengue, the Zika virus and other diseases caused by the Aedes aegypti mosquito has been of great concern to health authorities, not only in Brazil, but worldwide. In parallel to the prevention campaigns, several efforts have been made to speed up the search for potential outbreaks of the transmitting mosquito. One of these efforts is the use of drones to capture aerial images in urban areas with a higher incidence of the disease. The use of drones has proved to be an excellent alternative, since they have greater flexibility and a low cost, when compared to the manned aircraft used in imaging tasks. However, images acquired by drones are usually analyzed manually (visually), which can be time-consuming for the health workers. Thus, the proposition of computational approaches that allow the automatic analysis of such images becomes much importance. This work investigated the use of a convolutional neural network (CNN) to detect tanks for storing water for domestic use (target objects), which frequently appear in aerial images of peripheral regions, and which are directly related to the mosquito foci. In conducting the experiments, the employed RNC was trained with 2,498 sub-images of 200 × 200 pixels manually extracted from a dataset of images acquired with the use of a drone in peripheral regions of the city of São Paulo. In the experiments carried out, the accuracy obtained was 93.37% in the training validation stage and 79.74% of success rate in the testing stage, indicating that the proposed approach is a good alternative to solve the investigated problem.

Keywords: Object recognition, computer vision, convolutional neural networks, drone, Aedes

aegypti.

1 INTRODUÇÃO

As epidemias de dengue, zika, chikungunya e febre amarela urbana, causadas pelo mosquito

Aedes aegypti, vem preocupando muito as autoridades da área de saúde, não só Brasil, mas do mundo

todo. Segundo o Ministério da Saúde, em 2019 (até 24 de agosto), foram registrados 1.439.471 de casos de dengue em todo o país, com crescimento de 599,5% em relação ao mesmo período de 2018 (205.791). A taxa de incidência, que considera a proporção de casos por habitantes, é de 690,4 casos por 100 mil habitantes (MS, 2020).

O Ministério da Saúde, com objetivo de combater ao mosquito Aedes aegypti lança campanhas publicitárias anualmente envolvendo gestores estaduais, municipais e a população. Só no ano de 2019, o governo federal gastou cerca de R$22 milhões com esse tipo de campanha publicitária.

O combate ao mosquito Aedes aegypti tem demandado inúmeros outros esforços, pois nem sempre os programas e campanhas de informação e mobilização das pessoas são conduzidos de forma adequada. Neste sentido, vários estudos vêm sendo feitos para agilizar a busca de possíveis focos do mosquito, principalmente em locais de difícil acesso tanto para os agentes de vigilância sanitária quanto os moradores. Neste sentido, uma alternativa tem sido o uso de veículos aéreos não tripulados (VANTs) para aquisição de imagens aéreas em regiões com maior incidência da doença (DINIZ e

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

MEDEIROS, 2018). Porém, na maioria das vezes as análises das imagens são conduzidas de forma manual.

Os VANTs têm sido muito usados nos últimos anos em tarefas que exigem aquisição de imagens aéreas. Entre as diversas aplicações estão: sensoriamento remoto (AGUIRRE-GÓMEZ et al., 2016, ALBUQUERQUE et al., 2017), saúde (CAPOLUPO et al., 2014; PASSOS et al., 2018), agricultura de precisão (ALVES, FERREIRA & CUSTÓDIO, 2017); e combate aos focos do mosquito Aedes aegypti (AGRAWAL et al., 2014; MEHRA et al., 2016; DINIZ & MEDEIROS et al., 2018; BRAVO, 2019).

Apesar de existirem trabalhos na literatura propondo o uso de VANTs para identificação de objetos e cenários suspeitos de serem possíveis focos do mosquito, em boa parte deles realiza-se a análise manual das imagens, como em DINIZ & MEDEIROS et al. (2018).

Dos trabalhos encontrados na literatura relatando o uso de VANTs em tarefas que visam a identificação de objetos e cenários que representam potenciais criadouros do mosquito Aedes aegypti, apenas os trabalhos de Agarwal et al. (2014), Mehra et al. (2016) e Passos et al. (2018) abordaram a análise automática das imagens. Contudo, os dois primeiros trabalhos indicam apenas a presença de cenários suspeitos nas imagens, sem fornecer localização espacial, enquanto o trabalho de Passos et

al. (2018) considera apenas a formação de uma base de imagens anotadas para ser utilizada em testes

de métodos de detecção automática de alguns objetos suspeitos (pneus, garrafas e outros recipientes que possam acumular água). Contudo, tal base ainda não está disponível na literatura.

Este trabalho tem como objetivo propor uma abordagem computacional, baseada em redes neurais convolucionais (RNCs), para identificação automática de objetos como caixas d’água (nos seus diversos formatos) e outros recipientes comumente usados para armazenamento de água para uso doméstico, como por exemplo, os tambores (metálicos ou plásticos).

2 FUNDAMENTAÇÃO TEÓRICA

2.1 AEDES AEGYPT: COMPORTAMENTO E LOCAIS PROPÍCIOS PARA SUA PROLIFERAÇÃO

O mosquito Aedes aegypti tem hábitos diurnos, no interior da residência ele pode ser encontrado, preferencialmente, em locais sombreados e escuros. O mosquito macho alimenta-se de seivas de plantas, enquanto a fêmea necessita de sangue humano para o amadurecimento dos ovos, que são depositados separadamente nas paredes internas dos objetos, próximos a superfícies de água, local que lhes oferece melhores condições de sobrevivência (MS, 2020).

Quanto à capacidade de voo, é sabido que o mosquito possui possibilidade de acesso a alturas como, por exemplo, chegar às caixas d’água, às calhas e terraços de edificações urbanas. Contudo,

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

sua potencialidade de voo não atingiria um prédio de quatro andares. Apesar disso, ele pode chegar a alturas mais elevadas se estiver alojado em elevadores, embalagens em geral, brinquedos, caixas de ferramentas e uma infinidade de outros objetos que podem conduzí-lo até a cobertura de qualquer edifício.

De acordo com o ministério da saúde, são diversos locais que podem ser potenciais criadouros do mosquito Aedes aegypti como caixas d’agua, água acumulada sobre a laje, lixos em sacos plásticos em lixeiras abertas, pneus, garrafas vazias, pratos sob vasos de plantas ou algum outro objeto que possa acumular agua da chuva, como ilustrado na Figura 1.

Figura 1: Exemplos de possíveis criadouros do mosquito Aedes aegypti.

Por isso, é importante ter cuidado com todos os locais que podem acumular água, pois os ovos são resistentes a dessecação e podem sobreviver no meio ambiente por até 450 dias, bastando pouca quantidade de água como uma pequena poça para que haja a eclosão das larvas. Se o recipiente que contém a água estiver bem tratado e com a quantidade de cloro recomendada, o mosquito não se desenvolve, devido ao cloro funcionar como repelente.

Feitas essas considerações, neste trabalho considerou-se como objeto-alvo a caixa d’agua (nos seus mais diversos formatos e materiais empregados na sua fabricação), tendo em vista a sua presença em quase todas as residências e a possibilidade dela não estar devidamente tampada, fato que ocorre com mais frequência nas regiões urbanas mais carentes.

2.2 VISÃO COMPUTACIONAL

Visão computacional (VC) pode ser definida como uma subárea do processamento de imagens que estuda o desenvolvimento de métodos e técnicas que possibilitam um sistema computacional interpretar imagens. Em outras palavras, um sistema de visão computacional (SVC) tem como objetivo dotar uma máquina com capacidade para descrever uma cena contida numa imagem digital (GONZALEZ & WOODS, 2000).

Em adição, um SVC eficiente deve ser capaz de extrair um conjunto de características que descreva com precisão uma cena e seja pequeno o suficiente para reduzir o tempo de processamento e, ao mesmo tempo, eficiente para viabilizar a construção de aplicações práticas como sistemas de

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

visão para robôs industriais, veículos autônomos, detecção de eventos em sistemas de vigilância, leitura automatizada de placas de veículos, inspeção industrial e reconhecimento de padrões biométricos, entre outras (ZHANG & LU, 2004).

Nos últimos anos, o interesse na área de visão computacional tem sido crescente e os avanços conseguidos têm possibilitado o desenvolvimento de aplicações práticas em diversos segmentos da indústria tais como o automotivo, farmacêutico e de cosméticos, cerâmico, metal-mecânico, têxtil, eletroeletrônico e a agroindústria (RODRÍGUEZ-PULIDO et al., 2013).

2.3 REDES NEURAIS CONVOLUCIONAIS (RNC)

As RNCs são redes de aprendizagem supervisionada que extraem propriedades topológicas a partir dos dados de entrada e utilizam a convolução em pelo menos uma de suas camadas. As RNCs vêm sendo amplamente aplicadas em tarefas de reconhecimento de padrões em imagens digitais, já que elas têm a habilidade de "aprender" os filtros empregados em processamento de imagens (ARAUJO et al., 2017).

Essa característica de aprendizado de filtros constitui uma das principais vantagens da aplicação de RNCs em imagens (OQUAB et al., 2014; LECUN, 2018). Contudo, se por um lado as RNCs possuem a vantagem de “embutir” etapas de pré-processamento de imagens, por outro lado seu treinamento requer grandes conjuntos de dados, o que eleva bastante o custo computacional. Assim, tem sido cada vez mais comum o uso de GPU (Graphics Processing Unit) no treinamento de RNCs, para compensar essa desvantagem.

Basicamente, a arquitetura de uma RNC consiste em três conjuntos de camadas: convolução, agrupamento (pooling) e totalmente conectadas, como ilustrado na Figura 2. Cada uma delas possui uma função específica na propagação do sinal de entrada (ARAUJO et al., 2017).

As camadas convolucionais são responsáveis por extrair atributos das imagens de entrada. Elas empregam filtros que acionam pequenos locais de uma imagem, e que são repetidos por toda imagem.

As camadas de pooling são utilizadas para simplificar as informações da camada de convolução. Para isso existem alguns métodos, como por exemplo: max pooling (calcula o máximo da região), mean pooling (calcula a média da região) e o min pooling (calcula o mínimo da região). O max pooling, no qual o valor máximo é passado como saída, é o mais utilizado.

Por fim as camadas totalmente conectadas são responsáveis por conectar todos os neurônios da camada de Pooling à cada camada de saída. Elas podem ser interpretada uma rede Multilayer

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761 Figura 2: Camadas de uma RNC.

Fonte: Araujo et al., 2017

2.4 KERAS

Keras1 é uma API (Application Programming Interface) de deep learning escrita em Python que funciona sobre a plataforma de aprendizagem de máquina TensorFlow desenvolvida pela Google. Ela possuiu uma interface simples e altamente produtiva para resolver problemas de aprendizagem de máquina, fornecendo blocos de construção para o desenvolvimento de soluções com alta produtividade (Keras, 2020).

Keras tem como vantagem tirar o máximo proveito dos recursos de escabilidade, podendo ser executada em TPU (Tensor processing unit) ou em GPU (Graphics Processing Unit), além de permitir salvar o modelo treinado e ser executada por exemplo, em dispositivos móveis (Keras, 2020).

Dadas as suas características, Keras tem ficando em primeiro lugar em termos de menções em trabalhos científicos e também tem sido adotada por pesquisadores de grandes organizações científicas, como a NASA (Keras, 2020).

3 MATERIAL E MÉTODO

3.1 CONJUNTO DE IMAGENS

Para a realização dos experimentos foram adquiridas 142 imagens com uso de um drone DJI

Phantom 3 professional equipado com uma câmera RGB Sony EXMOR 12.4 MP. As aquisições

ocorreram em um bairro do extremo leste do município de São Paulo.

As imagens, com resolução de 3000×4000 pixels, possuem objetos-alvo (caixas e outros reservatórios de água), que podem caracterizar possíveis focos do mosquito. Os voos foram realizados com distâncias de 30 m (aquisição 1) e 40 m do solo (aquisição 2), com GSD (Ground Sample

Distance) de 1,30 e 1,73 cm/px, respectivamente.

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

3.2 MÉTODO PROPOSTO PARA DETECÇÃO DOS OBJETOS-ALVO

A arquitetura da Rede neural convolucional (RNC) desenvolvida com o uso da API Keras (RNC-Keras), para detecção dos objetos-alvo, é composta por 2 camadas convolucionais, 2 de pooling e duas camadas totalmente conectada, como ilustrado na Figura 3.

Figura 3: Arquitetura da RNC-Keras desenvolvida.

A RNC-Keras foi treinada com 2.498 subimagens de 200×200 pixels, extraídas manualmente de 127 imagens (90%) separadas para as etapas de treinamento e validação. Para os testes finais da

RNC-Keras foram empregadas as 15 imagens (10%) restantes do mesmo conjunto. Vale ressaltar que a técnica conhecida como data augmentation, incorporada no Keras, foi empregada para realizar aumento de dados durante o treinamento.

Foram configurados os seguintes parâmetros para o treinamento da RNC-Keras: input_shape de 200×200 com 3 canais, filtros de tamanho 32 nas camadas convolucionais, função de ativação Relu para as camadas de convolução, Polling de 3×3, camadas totalmente conectadas com 128 neurônios com a função de ativação Relu, batches = 32, normalização dos dados no intervalo [0, 1], taxa de aprendizagem = 0,0001, número de épocas = 12.000, perda de validação desejada = 0,05.

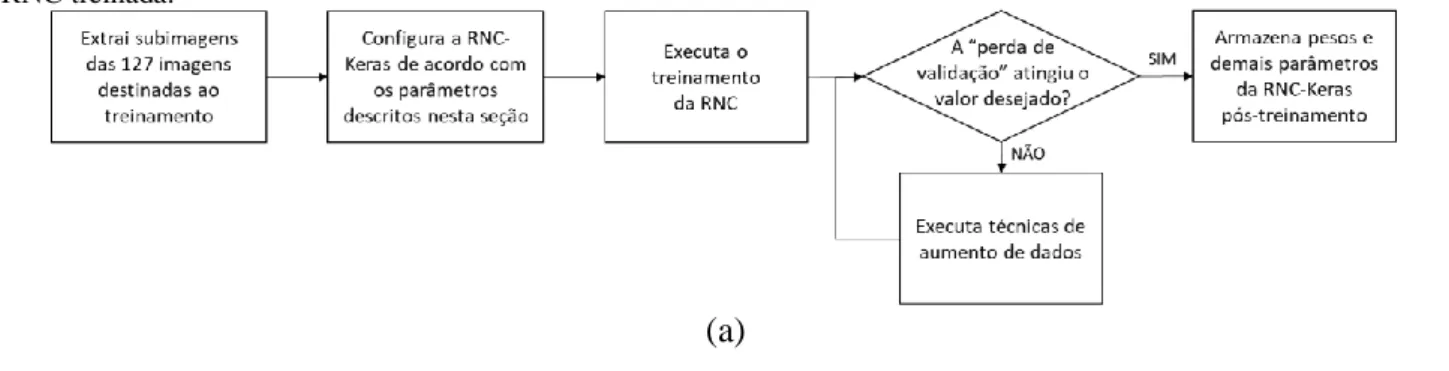

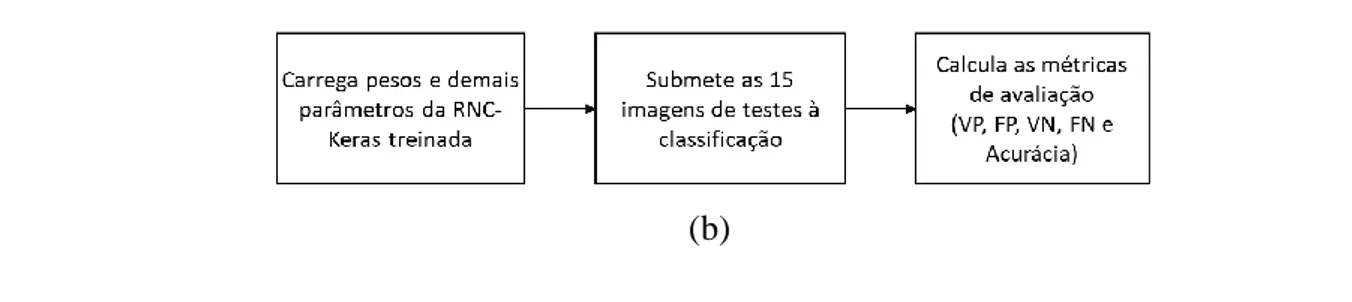

Após 56 horas de treinamento, totalizando as 12.000 épocas, o valor da perda de validação foi de 0,13, com cerca de 74.940 subimagens geradas pela técnica de aumento de dados. Os diagramas da Figura ilustram o funcionamento do método proposto para a detecção dos objetos-alvo, envolvendo as etapas de treinamento e testes.

Figura 4: Diagramas do funcionamento do método para a detecção dos objetos-alvo. (a) treinamento, (b) testes com a RNC treinada.

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

(b)

4 RESULTADOS

Para avaliar a acurácia da RNC desenvolvida na detecção de caixas d’água (considerando os diversos formatos e materiais empregados na fabricação) além de outros recipientes comumente usados para armazenamento de água para uso doméstico, 15 imagens foram submetidas à classificação, sendo os resultados apresentados na Tabela 1.

Tabela 1: Resultados das detecções feitas por RNC-Keras nas 15 imagens destinadas aos testes. Imagem Qtd. de objetos- alvo Detecções corretas (VP) Imagem Qtd. de objetos-alvo Detecções corretas (VP) Img01 4 4 Img09 6 4 Img02 8 8 Img10 3 2 Img03 10 9 Img11 4 3 Img04 2 2 Img12 9 6 Img05 6 6 Img13 6 3 Img06 4 3 Img14 3 2 Img07 4 4 Img15 4 2 Img08 6 5 --- --- ---

Os resultados apresentados na tabela 1 mostram o bom desempenho do método, que foi capaz de detectar corretamente 63 dos 79 objetos-alvo contidos nas 15 imagens (aproximadamente 80% de acertos). Pode-se observar que as imagens adquiridas com distância mais elevadas tendem apresentar um maior número de falsos positivos ou falsos negativos, em virtude dos objetos-alvo se tornarem menores, dificultando a extração de algumas características importantes deles para a generalização do classificador.

As figuras 5 a 7 a ilustram exemplos de imagens processadas por RNC-Keras, nas quais há casos de verdadeiros positivos − VP, falsos positivos − FP e falsos negativos − FN.

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761 Figura 5: Exemplo onde RNC-Keras detectou corretamente todos os objetos-alvo.

(a) imagem original (b) imagem processada por RNC-Keras

Na Figura 5 é possível notar que todos os objetos-alvo foram classificados corretamente, mesmo no caso em que uma das caixas tem apenas metade aparecendo na imagem.

Já na Figura 6 é possível identificar um caso de FP, destacado com círculo vermelho. Ressalta-se que o objeto detectado erroneamente é muito parecido com uma caixa d’água azul, podendo enganar até mesmo a visão humana.

Por fim, na Figura 7 são presentados dois casos de FP destacados com círculo vermelho, além de um caso de FN destacado com círculo amarelo. Nos casos de FP, a RNC-Keras confundiu parte de um telhado de amianto com caixas d’ água produzidas pelo mesmo tipo de material. Já o caso de FN trata-se mesmo de uma falha da RNC, que deve ser corrigida com refinamento do treinamento.

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761 Figura 6: Exemplo onde RNC-Keras detectou um objeto (círculo vermelho) que não era alvo (FP).

(a) imagem original (b) imagem processada por RNC-Keras

Figura 7: Exemplos de FP (círculo vermelho) e FN (círculo amarelo) cometidos por RNC-Keras.

(a) imagem original (b) imagem processada por RNC-Keras

5 CONCLUSÕES E TRABALHOS FUTUROS

Os bons resultados conseguidos neste trabalho, acurácia de 93,37% na etapa de validação do treinamento e 79,74% de acertos na etapa de testes, mostram que a abordagem proposta pode compor

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

um sistema de visão computacional a ser empregado por agentes de saúde em suas tarefas de inspeção. Contudo, os casos de falsos positivos e falsos negativos na classificação indicam a necessidade de se realizar novos experimentos, possivelmente aumentando o número de imagens e explorando outros parâmetros no treinamento da RNC. Também será considerada em trabalhos futuros a detecção de cenários representados pela junção de pequenos objetos que podem acumular água como, por exemplo, lixo a céu aberto, acúmulo de sujeira sobre lajes e telhados e calhas, além de lajes com acúmulo de água parada.

AGRADECIMENTOS

Os autores agradecem à FAPESP − Fundação de Amparo à Pesquisa do Estado de São Paulo pelo

auxílio concedido (Proc. 2017/05188-9), ao CNPq − Conselho Nacional de Desenvolvimento Científico e Tecnológico pela bolsa de desenvolvimento tecnológico (DT) concedida à S. A. Araújo (Proc. 313765 / 2019-7) e à UNINOVE pela bolsa de mestrado concedida à G. A. Lima, por meio do Programa de Estímulo à Formação de Pesquisadores.

REFERÊNCIAS

AGARWAL, A. et al. Detection of potential mosquito breeding sites based on community

sourced geotagged images. SPIE, 2014.

AGUIRRE-GÓMEZ, O. S.-G. G.-R. &. P.-H. Use of unmanned aerial vehicles and remote sensors

in urban lakes studies in Mexico. International Journal of Remote Sensing, 2016.

ALBUQUERQUE, R. W. et al. Uso do índice MPRI na avaliação de processos de Restauração

Florestal (RF) utilizando sensor RGB a bordo de VANT quadricóptero. Simpósio Brasileiro de

Sensoriamento Remoto, 2017.

ALVES, M. O.; FERREIRA, R. V.; CUSTODIO, V. Interpretação de imagens de drone e do

sensor OLI/ Landsat 8 para identificação de pragas e doenças na cana-de-açúcar. Anais do

XVIII Simpósio Brasileiro de Sensoriamento Remoto-SBSR, 2017.

ARAUJO, F. H. D. et al. Redes Neurais Convolucionais com Tensorflow: Teoria e Prática. SOCIEDADE BRASILEIRA DE COMPUTAÇÃO. III Escola Regional de Informática do Piauí. Livro Anais-Artigos e Minicursos, v. 1, p. 382-406, 2017.

BRAVO, D. T. Identificação automática de possíveis criadouros do mosquito Aedes aegypti a

partir de imagens aéreas adquiridas por Vants. Tese submetida ao curso Doutorado em

Informática e Gestão do Conhecimento, como requisito para o título de doutor em Informatica e Gestão do Conhecimento., 2019.

CAPOLUPO, A. et al. Indirect field technology for detecting areas object of illegal spills harmful

to human health. applications of drones, photogrammetry and hydrological models. Geospat

Braz. J. of Develop., Curitiba, v. 6, n. 7, p. 50702-50713 jul. 2020. ISSN 2525-8761

DINIZ, M. T. M.; MEDEIROS, J. B. D. Mapeamento de criadouros de reprodução de aedes

aegypti na cidade de Caicó/RN com o auxílio de veículo aéreo não tripulado. Revista

GeoNordeste, 2018.

GONZALEZ, R. C.; WOODS, R. E. Processamento de imagens digitais. São Paulo: Edgard Blucher, 2000.

KERAS. About Keras. Disponivel em: <https://keras.io/api/>. Acesso em: 10 Junho 2020.

LECUN, Y. et al. Gradient-based learning applied to document recognition. IEEE, p. 1717-1724, 1998.

MEHRA, M. et al. Image analysis for identifying mosquito breeding grounds. IEEE International Conference on Communication and Networking (SECON Workshops), 2016.

MS Ministerio da saude, 10 Maio 2020. Disponivel em: <https://www.saude.gov.br/

noticias/agencia-saude/45257-ministerio-da-saude-alerta-para-aumento-de-149-dos-casos-de-dengue-no-pais>.

PASSOS, W. L. et al. Acerca da Detecção Automática de Criadouros do Mosquito Aedes aegypti. Anais do XXXVI Simpósio Brasileiro de Telecomunicações e Processamento de Sinais, 2018.

RODRÍGUEZ-PULIDO, F. et al. Analysis of food appearance properties by computer vision

applying ellipsoids to colour data. Computers and Electronics in Agriculture, v. 99, 2013. 108–115.

ZHANG; DENGSHENG; LU, G. Review of shape representation and description techniques.