CURSO TÉCNICO DE

INFORMÁTICA

REDES DE COMPUTADORES II

Parte 2

Bruno Fernandes Guedes

Módulo IV

REDES DE

COMPUTADORES II

Parte 2

Disciplina do Curso Técnico de Informática do CEFET/RJ UnED NI

Edição: CEFET/RJ UnED NI

–

COORDENAÇÃO DE INFORMÁTICA

Local: Estrada de Adrianópolis, 1317

–

Santa Rita, Nova Iguaçu - RJ

Editora: CEFET/RJ

Presidente da República

Dilma Rousseff

Ministro da Educação

Aloizio Mercadante

Secretário de Educação Profissional e Tecnológica

Eliezer Moreira Pacheco

Professor – organizador

Bruno Fernandes Guedes

Diretor Geral do CEFET/RJ

Carlos Henrique Figueiredo Alves

Diretora de Ensino

Gisele Maria Ribeiro Vieira

Coordenadora da Educação à Distância no CEFET/RJ

Maria Esther Provenzano

Coordenador Geral do e-Tec no CEFET/RJ

Mauro Godinho Gonçalves

Coordenador Geral Adjunto do e-Tec no CEFET/RJ

Alexandre Martinez dos Santos

Coordenadora do Curso Técnico de Informática do e-Tec no CEFET/RJ -

UnED de Nova Iguaçu

Rosana Soares Gomes Costa

Coordenador de Tutoria do e-Tec no CEFET/RJ

Unapetinga Hélio Bomfim Vieira

Professora Pesquisadora do e-Tec no CEFET/RJ

Lucia Helena Dias Mendes

Design Instrucional

Luciana Ponce Leon Montenegro de Morais Castro

Ficha catalográfica elaborada pela Biblioteca Central do CEFET/RJ C Curso técnico de informática, módulo IV: Redes de Computadores II

disciplina Currículo do Curso Técnico de Informática do CEFET-RJ / Bruno Fernandes Guedes (org.). Rio de Janeiro: CEFET/RJ, – 2017. 90 p. : il. color. ; enc.

1. Redes de Computadores IV. 2. Servidores Linux. 3. Servidores Windows. I. Centro Federal de Educação Tecnológica Celso Suckow da Fonseca.

II. Guedes, Bruno Fernandes (org.). III. Título

Apresentação do e-Tec Brasil

Prezado estudante,

Bem vindo ao e-Tec Brasil!

Você faz parte de uma rede nacional pública de ensino, a Escola Técnica Aberta do Brasil, instituída pelo Decreto n° 6.301, de 12de dezembro de 2007, com o objetivo de democratizar o acesso ao ensino técnico público, na modalidade a distância. O programa é resultado de uma parceria entre o Ministério da Educação, por meio das Secretarias de Educação Profissional e Tecnológica (SETEC), as universidades e escolas técnicas estaduais e federais.

A educação à distância no nosso país, de dimensões continentais e grande diversidade regional e cultural, longe de distanciar, aproxima as pessoas ao garantir acesso à educação de qualidade, e promover o fortalecimento da formação de jovens moradores de regiões distantes, geograficamente ou economicamente, dos grandes centros.

O e-Tec Brasil leva os cursos técnicos a locais distantes das instituições de ensino e para a periferia das grandes cidades, incentivando os jovens a concluir o ensino médio. Os cursos são ofertados pelas instituições públicas de ensino e o atendimento ao estudante é realizado em escolas-polo integrantes das redes públicas municipais e estaduais.

O Ministério da Educação, as instituições públicas de ensino técnico, seus servidores técnicos e professores acreditam que uma educação profissional qualificada – integradora do ensino médio e educação técnica, - é capaz de promover o cidadão com capacidades para produzir, mas também com autonomia diante das diferentes dimensões da realidade cultural, social, familiar, esportiva, política e ética.

Nós acreditamos em você!

Desejamos sucesso na sua formação profissional!

Ministério da Educação

Janeiro de 2010

Indicação de ícones

Curiosidades: indica informações interessantes que enriquecem o assunto.

Interrogação: indica perguntas frequentes do aluno em relação ao tema e respostas às mesmas.

Você sabia? : oferece novas informações e notícias recentes relacionadas ao tema estudado.

Lembrete: enfatiza algum ponto importante sobre o assunto. Uma falha!

Tome nota 2: espaço também dedicado às anotações do aluno. Outra falha!

Mãos a obra: apresenta atividades em diferentes níveis de aprendizagem para que o estudante possa realizá-las e conferir o seu domínio do tema estudado.

SUMÁRIO

Palavra do Professor – organizador...08

Apresentação da Disciplina...09

Projeto Instrucional...10

Aula 1 Servidores Linux...12

Aula 2 Compartilhamento da conexão à Internet...25

Aula 3 Serviço de DHCP...34

Aula 4 Serviço de Proxy...43

Aula 5 Servidores Windows...57

Aula 6 Active Directory...65

Aula 7 Configurando um domínio com o Windows Server...77

Referências Bibliográficas...89

COM A PALAVRA, O PROFESSOR...

Caro aluno,

Quando falamos em redes de computadores, geralmente pensamos em uma série de computadores ligados entre si por meio de cabos para trocarem dados ou então fazemos logo uma associação direta com a internet. A disciplina de Redes de Computadores de fato estuda estas coisas, porém vai muito além disso pois o assunto de redes de computadores é algo bastante amplo e possui uma quantidade enorme de aplicações.

Devido à popularização das redes locais e aos servidores de baixo custo, montados usando componentes similares aos usados nos desktops, é cada vez mais comum o uso de sistemas, como o Linux ou o Windows Server, que disponibilizam serviços que ajudam a controlar e administrar uma rede local, seja ela grande ou pequena. Contudo, ser um administrador de redes exige um grande volume de conhecimento. Como ponto de partida para essa jornada, o objetivo desse material é apresentar informações referentes aos principais serviços comumente utilizados em uma rede local.

É importante que você compreenda que, devido a limitações referentes ao número de páginas, o conteúdo exposto nesta apostila não é suficiente para uma formação de alto nível. Por essa razão, como nas demais disciplinas, você será exposto a material, aulas de laboratório e exercícios complementares, de sorte a adquirir as competências necessárias para o desempenho de suas futuras atividades profissionais.

Apresentação da Disciplina

MÓDULO IV–Redes de Computadores II Carga Horária

75 horas

Espera-se que o(a) cursista desenvolva as seguintes competências: Mais uma falha!

• Compreensão das principais características dos servidores Linux.

• Compreensão das principais questões relacionadas ao compartilhamento da conexão à Internet;

• Compreensão dos principais conceitos relacionados aos serviços de DHCP, e Proxy;

• Compreensão acerca das principais características dos servidores Windows;

Projeto instrucional

Disciplina: Redes de Computadores II (Carga horária: 75 horas)

Ementa: Servidores Linux – Compartilhamento da conexão à Internet – Serviço de DHCP – Serviço de Proxy – Servidores Windows – Active Directory – Configurando um domínio com o Windows Server.

AULA OBJETIVOS DE

APRENDIZAGEM MATERIAIS

CARGA HORÁRIA

(horas)

1- Servidores Linux

Compreender os principais conceitos sobre os servidores Linux;

Conhecer os principais serviços de um servidor Linux para redes locais;

Impressos 4

2- Compartilhamento da conexão à Internet

Compreender as principais questões relacionadas ao compartilhamento da conexão à Internet;

Configurar o compartilhamento da conexão à Internet utilizando um servidor Linux;

Impressos 4

3- Serviço de DHCP

Compreender as principais características do serviço de DHCP;

Configurar o serviço de DHCP em um servidor Linux;

Impressos 4

4- Serviço de Proxy

Compreender os principais conceitos relacionados ao

AULA OBJETIVOS DE

APRENDIZAGEM MATERIAIS

CARGA HORÁRIA

(horas)

5- Servidores Windows

Conhecer as principais características dos servidores Windows;

Instalar e configurar o Windows Server

Impressos 4

6- Active Directory

Entender os principais conceitos relacionados ao Active Directory;

Configurar o serviço de controlador de domínio no Windows Server;

Impressos 4

7- Configurando um domínio com o Windows Server

Configurar usuários e políticas de segurança em um domínio com o Windows Server;

Ingressar clientes Windows em um domínio;

Meta:

Apresentar as características acerca dos servidores Linux.

Objetivo: Ao final desta aula você deverá ser capaz de:

Compreender os principais conceitos relacionados aos servidores Linux;

1.1 – Introdução

Estudando sobre a história do Linux e do Unix de uma forma geral, você vai perceber rapidamente que o sistema foi desenvolvido, originalmente, para uso em servidores, compartilhados por muitos usuários. Um servidor é uma máquina que fica o tempo todo ligada, sempre fazendo a mesma coisa. Existem vários tipos de servidores, sendo que uma única máquina pode rodar simultaneamente vários serviços, dependendo apenas dos recursos de hardware e da carga de trabalho. A palavra "serviço" indica, nesse caso, um aplicativo destinado a responder requisições dos clientes.

Os servidores Linux podem ser divididos em dois grandes grupos: os servidores de rede local e os servidores de Internet. Os servidores de rede local são tipicamente usados para compartilhar a conexão, compartilhar arquivos e impressoras, autenticar os usuários e servirem como firewall, enquanto os servidores de Internet hospedam sites e aplicações disponíveis para a grande rede.

De início, configurar um servidor Linux pode parecer complicado, pois existem muitas opções de distribuições e de ferramentas de configuração. Praticamente qualquer distribuição Linux pode ser usada como servidor, pois os serviços utilizados são os mesmos, mudando apenas o processo de instalação. Contudo, as distribuições mais usadas são o Debian, CentOS, Fedora (ou o Red Hat Enterprise, para quem precisa de suporte comercial), Ubuntu, SuSE e Mandriva.

1.2 – Servidores de rede local

Dentro de uma rede local, tudo começa com o cabeamento, onde você pode empregar uma combinação de rede cabeada e pontos de acesso wireless. Dessa maneira, você pode usar a rede cabeada para interligar os desktops e a rede wireless para os notebooks e dispositivos móveis em geral.

Segundo o http://www.top500.

org/ (que mantém um rank atualizado dos 500

super computadores mais poderosos

do mundo), em novembro de 2008

nada menos do que 439 dos 500

super computadores mais poderosos

rodavam diferentes versões

do Linux. Dos restantes, 25 rodavam outros sistemas Unix e apenas 5 rodavam

Windows, um deles com o HPC

Server 2008 e quatro com o

Windows Computer Cluster Server 2003, duas

versões do Windows especialmente otimizadas para a

Com a rede funcionando, o primeiro passo é compartilhar a conexão com a Internet, o que no Linux pode ser feito de forma bastante simples, conforme veremos na Aula 2. Ao ativar o compartilhamento, seu servidor passa a funcionar como um roteador doméstico convencional, o qual adquirimos justamente para esse fim, encaminhando os pacotes da rede local para a Internet e vice-versa.

Em muitas situações o acesso à Internet precisa ser controlado. Em um ambiente de trabalho, normalmente não é desejado que os funcionários fiquem acessando o Facebook durante o expediente, e nenhum diretor vai querer que os alunos fiquem usando os micros da biblioteca para baixar filmes e música, por exemplo. Ao utilizarmos um servidor Linux existe a possibilidade de monitorar e limitar o acesso à web, o que pode ser feito de forma bastante eficiente utilizando o Squid, que veremos em detalhes na Aula4. Outra possibilidade é incluir um servidor DHCP, que será detalhado na Aula 3. Ele automatiza a configuração da rede, permitindo inclusive fornecer IPs fixos para as estações.

1.3 – Configurando um ambiente de testes

Se você precisa de uma máquina para fazer um teste qualquer, certamente o Virtual Box é a melhor opção. Conforme vimos anteriormente na disciplina de Sistemas Operacionais, em um passe de mágica você tem uma ou mais máquinas à mão e pode começar o trabalho. Se você está estudando servidores de redes, geralmente terá uma máquina como cliente e outra como servidor, ou duas máquinas virtuais.

Um exemplo de rede bem simples, e extremamente comum é a rede local e uma máquina com duas placas de rede atuando como servidor de alguma coisa e compartilhando a conexão com à Internet.

O Squid é um servidor proxy, que serve como um intermediário entre a rede local

e a Internet. Dependendo da configuração, ele

pode otimizar a conexão, logar

os acessos ou pode ser usado

para efetivamente bloquear sites indesejados, bloquear determinados tipos de arquivos, restringir o acesso baseado

Este cenário é facilmente simulado no Virtual Box. Basicamente o que precisamos fazer é criar duas máquinas, sendo que uma delas com duas placas de rede, e mais alguns ajustes para termos o cenário pronto.

É importante lembrar que cada máquina virtual em funcionamento irá consumir a quantidade de memória que lhe foi dada do seu sistema, então se você tem uma máquina com 2GB de RAM por exemplo, considerando que o sistema operacional hospedeiro consuma 1GB, você pode criar 2 máquinas virtuais com 256MB de memória ou mesmo uma delas com 512MB. Você pode fazer os testes e pode depois aumentar ou diminuir a memória de cada máquina virtual conforme necessário, deixando sempre um “folga” para o sistema hospedeiro (máquina real).

Vamos supor que queiramos treinar a configuração de um servidor Linux com Ubuntu que compartilhe à Internet para uma máquina com Windows. Para isso, primeiro crie duas máquinas virtuais.

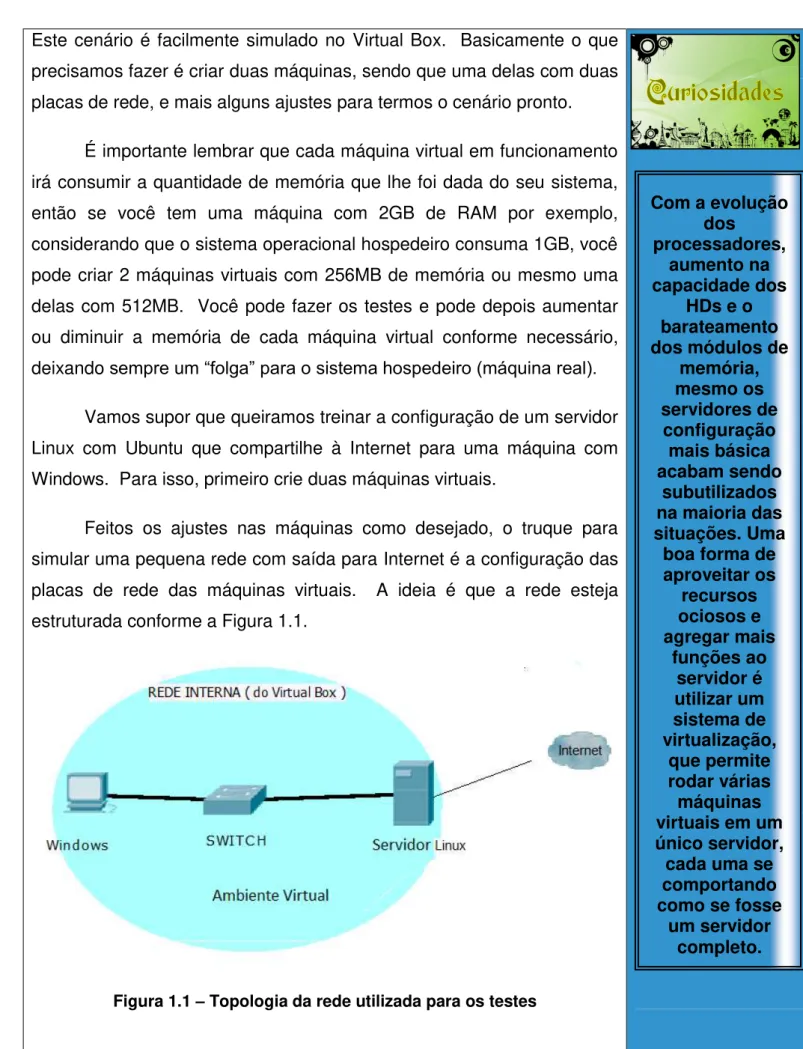

Feitos os ajustes nas máquinas como desejado, o truque para simular uma pequena rede com saída para Internet é a configuração das placas de rede das máquinas virtuais. A ideia é que a rede esteja estruturada conforme a Figura 1.1.

Figura 1.1 – Topologia da rede utilizada para os testes

Com a evolução dos

processadores, aumento na capacidade dos

HDs e o barateamento dos módulos de

memória, mesmo os servidores de configuração mais básica acabam sendo subutilizados na maioria das situações. Uma

boa forma de aproveitar os recursos ociosos e agregar mais funções ao servidor é utilizar um sistema de virtualização, que permite rodar várias máquinas virtuais em um único servidor, cada uma se comportando como se fosse

O intuito é simular uma rede virtual entre as máquinas virtuais, como em uma rede doméstica, sendo que uma das máquinas possuirá duas placas de rede, uma conectada a rede local e a outra conectada à rede externa, com acesso à Internet.

Por padrão o Virtual Box deixa as placas de rede configuradas no que eles chamam de NAT. Podemos dizer que a placa de rede virtual usa serviços do próprio Virtual Box e utiliza o modo NAT para intermediar as conexões da máquina virtual com o “lado de fora”. É uma técnica muito boa e deixa tudo transparente, no entanto para quem quer um ambiente o mais próximo do real possível pode deixar as coisas confusas.

Para mudarmos esse parâmetro de configuração, basta clicar com o botão direito na máquina virtual ir em “configurações” e no menu “Rede”, conforme mostrado na Figura 1.2.

Na máquina que atuará como cliente deixe apenas uma placa de rede e configure-a no modo “Rede interna”. Na máquina que atuará como servidor, a primeira placa de rede estará no mesmo modo (Rede interna). Com isso já temos uma pequena rede isolada, que funciona apenas entre as maquinas virtuais. Agora basta adicionar uma segunda placa de rede no servidor e configurá-la em modo “Bridge” com a sua placa de rede real. No caso de notebooks, que geralmente possuem duas interfaces de redes (uma para rede cabeada e outra para rede sem fio), escolha a interface que você utiliza para acessar à Internet.

Neste modo de operação a interface virtual é tão cliente da sua rede (real) como o seu PC hospedeiro. Ela receberá IP da sua rede e será como qualquer outra máquina nela. A sua interface real será ligada em camada 2 com a interface da máquina virtual.

É importante ressaltar que você pode ainda adicionar outras máquinas dentro da sua rede virtual apenas configurando a interface em modo “Rede interna”. Contudo, atente para o fato de quanto mais máquinas virtuais você instanciar, mais recursos da sua máquina real serão consumidos, tornando o sistema mais lento. Para os testes propostos nas próximas Aulas, a topologia sugerida é mais do que suficiente.

Por fim, a máquina servidora terá uma outra interface como se conectada diretamente na sua rede simulando a conexão com o que seria o seu provedor de internet.

Mãos à obra. Agora você tem dois computadores prontos para receberem as configurações de serviços de rede e um servidor Linux para compartilhar à Internet e (ou) oferecer outros serviços à sua rede interna (virtual).

1.4 – Configurando as interfaces de redes

A configuração de rede no Windows é um assunto bastante conhecido, pois a configuração é bastante similar entre as diferentes versões do Windows e a configuração gráfica torna tudo mais simples. Já a configuração de rede no Linux, que apesar de aparentemente complicada, não é tão exótica quanto pode parecer à primeira vista.

A primeira coisa a ter em mente com relação à configuração de rede no Linux é que, como quase tudo no sistema, a configuração pode ser feita tanto usando utilitários gráficos quanto diretamente, através de comandos e da edição dos arquivos de configuração. Existe uma grande variação com relação aos utilitários de configuração, já que cada distribuição adota um utilitário diferente, mas os passos da configuração manual são quase sempre os mesmos, com poucas variações.

Independente do sistema operacional usado, as informações básicas para que o micro possa acessar a Internet através da rede são:

Endereço IP - Os endereços IP identificam cada micro na rede. A regra básica é que cada micro deve ter um endereço IP diferente.

a divisão do endereço, rede e host.

Default Gateway (gateway padrão) - É justamente o micro da rede que tem a conexão, que os outros consultarão quando precisarem acessar qualquer coisa na Internet.

Servidor DNS - Faz parte da configuração da rede informar os endereços DNS do provedor (ou qualquer outro servidor que você tenha acesso), que é para quem seu micro irá perguntar sempre que você tentar acessar qualquer coisa usando um nome de domínio e não um endereço IP.

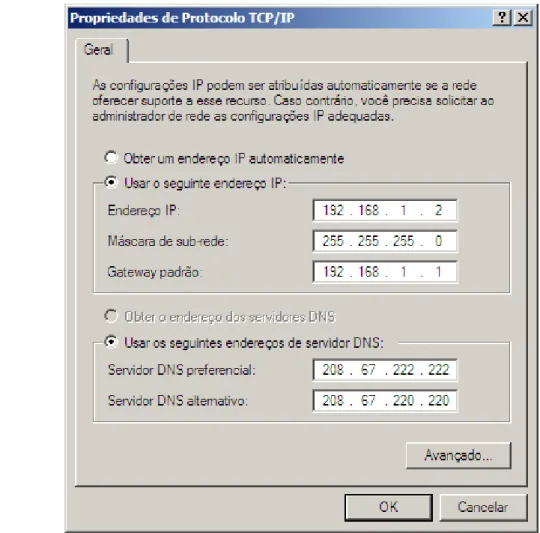

Um exemplo de configuração de rede completa para um dos micros da rede, que vai acessar a internet através do micro que está compartilhando a conexão seria:

IP: 192.168.1.2

Máscara: 255.255.255.0

Gateway: 192.168.1.1 (endereço do PC compartilhando a conexão) DNS: 208.67.222.222 ; 208.67.220.220

O micro que está compartilhando a conexão por sua vez vai ter duas placas de rede, uma para a Internet e outra para a rede local, por isso vai ter uma configuração separada para cada uma.

1.4.1 – Configurando a interfaces de rede no Windows XP

No Windows XP, a configuração de rede é dividida em duas partes. A principal vai dentro do "Painel de Controle > Conexões de rede", onde são listadas todas as interfaces de rede disponíveis.

Dentro das propriedades de cada interface, vai uma lista dos protocolos e dos serviços disponíveis. O suporte ao protocolo TCP/IP é instalado por padrão. Em seguida temos o "Cliente para redes Microsoft", que permite que você acesse compartilhamentos de rede em

Até o Windows 98, a configuração da rede era baseada

em um conceito muito confuso,

onde os protocolos eram

outras máquinas e o "Compartilhamento de arquivos e impressoras para redes Microsoft", que é o componente servidor, que permite que você compartilhe arquivos e impressoras com outras máquinas da rede.

A configuração da rede vai dentro das propriedades do protocolo TCP/IP, onde você pode escolher entre ativar o cliente DHCP ou configurar manualmente os endereços. O segundo servidor DNS é desejável pela questão da redundância, mas não é obrigatório dentro da configuração. Além de usar os endereços de DNS do provedor, você pode usar um servidor de DNS instalado em uma máquina da rede local ou ainda um servidor de DNS público, como os servidores públicos do Google (8.8.8.8 e 8.8.4.4). Um exemplo de configuração completo para uma interface de rede no Windows XP é mostrada na Figura 1.3.

1.4.2 – Configurando a interfaces de rede no Ubuntu 10.04

No Linux, as placas de rede Ethernet (ou cabeadas) recebem nomes como "eth0" (primeira placa), "eth1" (segunda placa), "eth2" (terceira placa) e assim por diante. No caso das placas wireless, o nome muda de acordo com o modelo e com o driver usado. Por exemplo, podem ser identificadas como "wlan0" ou "ra0".

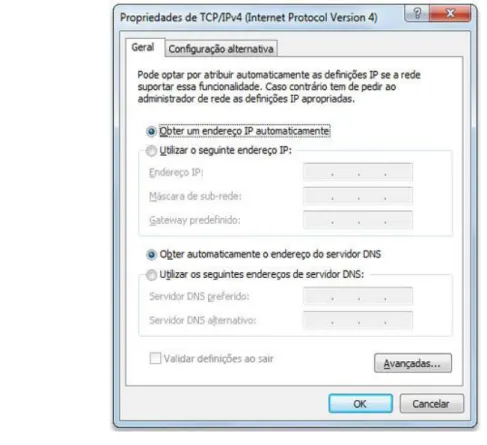

O Ubuntu, usa o networkmanager como utilitário de configuração da rede. Ele fica ativo ao lado do relógio e é carregado automaticamente durante o boot do sistema. Ele tem a função de detectar as redes wireless disponíveis, mostrando uma lista que facilita a conexão e também de detectar a inserção do cabo de rede. A partir do momento em que o cabo de rede está conectado, ele tenta configurar a rede via DHCP. É por isso que em muitos casos o sistema configura a rede "sozinho", sem que você precise fazer nada.

Por padrão, ele tenta configurar todas as conexões via DHCP (e desativa a conexão caso o DHCP não esteja disponível, ou o servidor esteja fora do ar), mas você pode também configurar os endereços manualmente, acessando as propriedades da interface, clicando com o botão direito sobre o ícone de rede e acessando o "Editar conexões", conforme mostrado na Figura 1.4.

Como de praxe, o utilitário de configuração, mostrado na Figura 1.5, é aberto com permissões administrativas. Mas, ao contrário de outras distribuições, onde seria solicitada a senha de root, o Ubuntu apenas confirma sua própria senha de usuário e abre o utilitário usando o sudo.

Figura 1.5 – Utilitário gráfico de configuração de rede do Ubuntu 10.04

Ao clicar em cima do nome de uma interface disponível e escolher a opção "Editar..." a tela da Figura 1.6 é mostrada, permitindo que você configure os parâmetros da interface.

Finalizando, se considerarmos o nosso servidor de exemplo, que possui duas interfaces de rede, teríamos que especificar as configurações para as duas interfaces do servidor, respeitando as especificidades de cada uma. Por exemplo, se assumirmos que a eth1

é a interface para a internet e a eth0 a interface para a rede local, deveríamos configurar a primeira em método "automático" (ou DHCP) e a segunda em método "manual", especificando apenas o IP e a máscara de sub-rede de acordo com a faixa de endereços escolhida para a rede local.

A T I V I D A D E D E A P R E N D I Z A G E M

1 – Utilizando o Virtual Box, monte a topologia de rede para testes conforme especificado nessa Aula.

2 – Configure a rede interna para utilizar endereços na faixa de

192.168.15.X com máscara 255.255.255.0.

Compartilhamento da conexão à

Meta:

Apresentar os principais conceitos referentes ao compartilhamento da conexão com a Internet usando um

servidor Linux.

Objetivo: Ao final desta aula você deverá ser capaz de:

Compreender as principais questões relacionadas ao compartilhamento da conexão à Internet;

2.1 – Introdução

Um dos usos mais comuns e mais simples para um servidor Linux de rede local é simplesmente compartilhar a conexão. A vantagem de usar um servidor dedicado ao invés de simplesmente compartilhar usando um dispositivo próprio, como um “roteador wireless” por exemplo, é que você pode incluir outros serviços, como de DHCP, Proxy, Firewall, compartilhamento de arquivos com a rede interna, impressão e assim por diante.

Em uma rede pequena ou média, com de 10 a 50 micros, é possível usar um único servidor de configuração razoável para todas estas funções. Em redes maiores, com 100 micros ou mais, isso passa a depender muito do nível de utilização do servidor. Por exemplo, uma máquina atual, como um Core I3 com 4 GB de memória e HD de 500 GB, pode rodar um Proxy para 200 micros com folga, incluindo serviços adicionais como um servidor de arquivos para os mesmos 200 micros. Além é claro de compartilhar a conexão para um número indefinido de clientes.

Máquinas mais parrudas podem desempenhar funções mais pesadas. Você pode, por exemplo, usar um virtualizador de máquinas, como o Proxmox, para rodar diversas máquinas virtuais, cada uma com um sistema operacional diferente, de forma a atender diversos usuários da rede. Dessa forma, você pode concentrar aplicativos Windows em uma máquina virtual com o Windows Server e usar outra máquina virtual com o Linux para oferecer os serviços citados acima e assim por diante, tudo isso em uma única máquina física.

2.2 – Compartilhando a conexão

Do ponto de vista da segurança e até mesmo da facilidade de configuração, é sempre recomendável usar um servidor com duas placas de rede, separando o tráfego proveniente da internet do tráfego da rede local. Entretanto, é possível utilizar um servidor com apenas uma placa de rede, embora a configuração seja mais complexa.

Como utilizaremos máquinas virtuais para os testes, nossa rede ficará com uma topologia similar a da Figura 2.1, com o servidor colocado entre a rede local e o dispositivo que conecta a sua rede à Internet, um “roteador wireless” no nosso exemplo. Uma das interfaces do servidor receberia um endereço de rede local, de forma a receber os acessos provenientes dos clientes da rede e a segunda seria configurada para acessar a Internet através do roteador wireless.

Figura 2.1 – Topologia da rede utilizada para o teste de compartilhamento.

Depois de montar a topologia, comece configurando a rede local usando uma das faixas de endereços IP reservadas como, por exemplo, a 192.168.1.x, onde o servidor fica com o IP 192.168.1.1 e o micro da rede interna receba endereços dentro da mesma faixa, conforme mostrado na Figura 2.2. O endereço IP de rede local do servidor (192.168.1.1 no exemplo) passa a ser o gateway da rede, já que é a ele que os clientes irão consultar quando precisarem acessar qualquer endereço externo.

Figura 2.2 – Configuração da interface do computador da rede local.

No caso da interface do servidor, o gateway padrão é definido apenas ao configurar a conexão com a Internet, não ao configurar a rede local. Caso você utilize um utilitário de configuração, como o networkmanager, para configurar as interfaces de rede no servidor, configure primeiro a interface de rede local, mantendo os campos do default gateway e dos servidores DNS em branco, deixando para configurar a interface da Internet por último.

Isso evita alguns erros comuns. Por exemplo, se você configurar a conexão com a web e depois configurar a rede local, colocando um endereço qualquer no campo "default gateway", o gateway informado na configuração da rede local vai substituir o gateway do provedor (definido

A maioria das distribuições Linux instala o

executável do Iptables, o firewall do Linux,

por padrão, mas sempre existem

exceções. No Mandriva, por exemplo, ele é instalado ao marcar a categoria "firewall" durante a instalação. Para instalá-lo posteriormente,

ao conectar na internet), fazendo com que a conexão deixe de funcionar.

Na configuração da placa de rede do servidor que acessará à Internet, podemos deixar a configuração no método automático (DHCP). Como configuramos o nosso ambiente virtual para que essa placa se comporte como uma interface conectada a nossa rede real, ela receberá todas as configurações necessárias para acessar à Internet através do nosso roteador wireless.

Finalizando, embora apenas mencionado na Aula 1, também é possível configurar as interfaces no Linux através do terminal e da edição de arquivos de configuração!

2.3 – Testando a conectividade

Antes de continuarmos com as nossas configurações, vamos testar se as configurações realizadas nas interfaces do nosso ambiente virtual de testes estão funcionando. Para isso basta testar se existe conectividade entre o servidor e o nosso computador Windows da rede interna e se a conexão com a Internet do servidor está funcionando corretamente.

Para os testes iremos utilizar o comando ping. O ping é um comando usado para testar a conectividade entre equipamentos, e foi criado para o uso em redes com a pilha de protocolo TCP/IP (como por exemplo a internet).

(ms). Quanto mais alto ele for, mais a estabilidade de sua conexão está comprometida com relação ao "destinatário" para o qual ela está sendo testada.

Para testar se existe conectividade entre o servidor Linux e o cliente Windows, podemos abrir um terminal no servidor e digitar o seguinte comando:

$ ping 192.168.1.56

Se a máquina cliente responder, a saída do comando será algo similar ao mostrado abaixo:

PING 192.168.1.56 (192.168.1.56) 56(84) bytes of data.

64 bytes from 192.168.1.56: icmp_req=1 ttl=64 time=49.1 ms

64 bytes from 192.168.1.56: icmp_req=2 ttl=64 time=1.09 ms

64 bytes from 192.168.1.56: icmp_req=3 ttl=64 time=0.985 ms

Caso contrário a saída será similar a mostrada a seguir:

PING 192.168.1.56 (192.168.1.56) 56(84) bytes of data.

From 192.168.1.1 icmp_seq=1 Destination Host Unreachable

From 192.168.1.1 icmp_seq=2 Destination Host Unreachable

From 192.168.1.1 icmp_seq=3 Destination Host Unreachable

Que dizer que o servidor (192.168.1.1), não obteve resposta do cliente cujo IP é 192.168.1.56.

Já para testar se o servidor está acessando a Internet, digitamos o seguinte comando:

$ ping www.google.com

PING www.l.google.com (190.98.170.34) 56(84) bytes of data.

64 bytes from 190.98.170.34: icmp_req=1 ttl=57 time=8.22 ms

64 bytes from 190.98.170.34: icmp_req=2 ttl=57 time=3.93 ms

Ao digitarmos o endereço do site do Google no lugar de um endereço IP, o comando precisará utilizar o DNS para resolver o nome de domínio consultado, no caso www.google.com, para obter o endereço IP do servidor que hospeda o site do Google. De posse desse endereço (190.98.170.34), o comando ping executa o teste de conectividade, só que agora para um host localizado na Internet. Se a saída for similar a mostrada acima, tudo está funcionando como deveria.

Finalizando, para interromper a execução do comando, basta pressionar as teclas CRTL + C. É importante ressaltar também que podemos executar esse comando como um usuário normal.

2.4 – Ativando o compartilhamento

Depois de tudo preparado, ativar o compartilhamento propriamente dito é bastante simples. No Linux, o compartilhamento é feito usando o Iptables, o firewall integrado ao Kernel. Na verdade, o Iptables é expandido através de módulos, por isso suas funções vão muito além das de um firewall tradicional, incluindo funções avançadas de roteamento. Para ativar o compartilhamento, são necessários apenas três comandos:

# modprobe iptable_nat

# echo 1 > /proc/sys/net/ipv4/ip_forward

# iptables -t nat -A POSTROUTING -o eth1 -j MASQUERADE

A T I V I D A D E D E A P R E N D I Z A G E M

1 – Utilizando o ambiente de testes que você configurou na atividade de aprendizagem da Aula 1, ative e teste o compartilhamento da conexão conforme estudado nessa aula.

2 – Faça com que as configurações de compartilhamento sejam executadas durante o boot do sistema.

com todas as demais placas de rede espetadas no servidor, por isso não é necessário especificar a placa de rede local.

O primeiro comando ativa o "iptable_nat", o módulo do Iptables responsável por oferecer suporte ao roteamento de pacotes via NAT. O segundo ativa o "ip_forward", o módulo responsável pelo encaminhamento de pacotes, utilizado pelo módulo iptable_nat.

Finalmente, o terceiro cria uma regra de roteamento, que orienta o servidor a direcionar para a Internet todos os pacotes (recebidos dos clientes) que se destinarem a endereços que não façam parte da rede local (ou seja, qualquer coisa fora da faixa 192.168.1.x). A partir daí, o servidor passa a ser o gateway da rede.

Meta:

Apresentar os principais conceitos relacionados ao serviço de DHCP.

Objetivo: Ao final desta aula você deverá ser capaz de:

Compreender as principais características do serviço de DHCP;

3.1. Introdução

Hoje em dia, quase todas as redes utilizam algum tipo de servidor

DHCP. Por ser um serviço simples e que consome poucos recursos, praticamente todos os “roteadores wireless”, por exemplo, os que utilizamos para compartilhar a Internet das nossas casas, já vem com esse serviço pré configurado de fábrica. Em geral, eles são ativados automaticamente ao compartilhar a conexão ou junto com algum outro serviço, de forma que você acaba não aprendendo muita coisa sobre a sua configuração.

De um modo geral, o trabalho de um servidor DHCP é bastante simples. Ele responde aos pacotes de broadcast das estações, enviando um pacote com um dos endereços IP disponíveis e os demais dados da rede. Conforme já estudado, os pacotes de broadcast são endereçados ao endereço "255.255.255.255" e são retransmitidos pelo switch da rede para todas as portas, diferente dos pacotes endereçados a um endereço específico, que são transmitidos apenas na porta relacionada a ele.

Periodicamente o servidor DHCP verifica se as estações ainda estão lá, exigindo uma renovação do "aluguel" do endereço IP. Isso permite que os endereços IP sejam gastos apenas com quem realmente estiver online, evitando que os endereços disponíveis se esgotem.

O servidor DHCP mais usado no Linux é o ISC DHCP, desenvolvido pela Internet Systems Consortium, uma organização sem fins lucrativos dedicada a desenvolver serviços de infra-estrutura usados na Internet.

3.2. Configurando um servidor DHCP

o cliente Windows da nossa rede local.

Nas distribuições derivadas do Debian, como o Ubuntu por exemplo, o pacote correspondente ao servidor DHCP se chama " dhcp3-server" e pode ser instalado via apt-get conforme o comando abaixo:

# apt-get install dhcp3-server

Com o pacote instalado, você pode ativar e desativar o serviço usando os comandos:

# /etc/init.d/dhcp3-server start # /etc/init.d/dhcp3-server stop

Note que os comandos devem ser executados como super usuário. Como você pode imaginar, o "3" corresponde à versão do software. Eventualmente ele será substituído pelo "dhcp4-server", o que resultará também na mudança do nome da pasta onde fica o arquivo e do script de inicialização referente ao serviço.

O arquivo de configuração é o "dhcpd.conf". Nas distribuições derivadas do Debian, como o Ubuntu, o caminho completo para ele é "/etc/dhcp3/dhcpd.conf". Em outras distribuições esse caminho pode mudar, contudo, apesar das diferenças estéticas entre as distribuições, o que interessa mesmo é a configuração do arquivo e esta sim é igual, independentemente da distribuição. Este é um exemplo de arquivo de configuração básico: # /etc/dhcp3/dhcpd.conf ddns-update-style none; default-lease-time 600; max-lease-time 7200; authoritative;

subnet 192.168.1.0 netmask 255.255.255.0 { range 192.168.1.100 192.168.1.199;

option routers 192.168.1.1;

option domain-name-servers 208.67.222.222,208.67.220.220; option broadcast-address 192.168.1.255;}

O servidor DNS mais usado no Linux é o Bind. O servidor DNS

pode ser configurado para implementar um sistema de domínios e subdomínios na sua rede, mas o uso mais comum

é simplesmente fazer um "cache",

onde o servidor DNS simplesmente

repassa as requisições para

A opção "default-lease-time" controla o tempo de renovação dos endereços IP. O "600" indica que o servidor verifica a cada dez minutos se as estações ainda estão ativas. Se você tiver mais endereços IP do que máquinas, os endereços IP das estações raramente vão precisar mudar. Mas, no caso de uma rede congestionada, o "max-lease-time" determina o tempo máximo que uma estação pode usar um determinado endereço IP. Isso foi planejado para ambientes onde haja escassez de endereços IP, como, por exemplo, em um provedor de acesso, onde sempre existem mais clientes do que endereços IP disponíveis e se trabalha contando que nem todos vão ficar conectados simultaneamente. Em condições normais, essas duas opções não são muito importantes. O que interessa mesmo é o bloco que vai logo abaixo, onde ficam as configurações da rede.

A opção "range" determina a faixa de endereços IP que será usada pelo servidor. Se você utiliza a faixa de endereços 192.168.1.1 até 192.168.1.254, por exemplo, pode reservar os endereços de 192.168.1.1 a 192.168.1.100 para estações configuradas com IP fixo e usar os demais para o DHCP, ou então reservar uma faixa específica para ele, de 192.168.1.101 a 192.168.1.201, por exemplo. O importante é usar faixas separadas para o DHCP e os micros configurados com IP fixo.

Na "option routers" vai o endereço do gateway da rede, ou seja, o endereço do servidor que está compartilhando a conexão. Não é necessário que o mesmo micro que está compartilhando a conexão rode também o servidor DHCP. Pode ser, por exemplo, que na sua rede o gateway seja o próprio “roteador wireless” que está compartilhando a conexão e o DHCP seja um dos PCs.

geral, você vai usar os próprios endereços DNS do provedor, a menos que você configure um servidor DNS interno na sua rede (que pode ser instalado no próprio micro que está compartilhando a conexão e rodando o DHCP). Estes serviços consomem poucos recursos da máquina.

Você pode substituir o arquivo de configuração padrão pelo modelo apresentado anteriormente, ou editá-lo conforme a necessidade. Ao fazer qualquer alteração no arquivo, você deve reiniciar o servidor DHCP usando o comando:

# /etc/init.d/dhcp3-server restart

Para as distribuições baseadas no Debian, como o Ubuntu.

Com o servidor DHCP configurado, você pode testar se o cliente Windows consegue pegar as configurações de rede automaticamente. Par isso altere a configuração da interface de rede para que ela obtenha um endereço IP automaticamente, conforme mostrado na Figura 3.1.

3.3. DHCP com IP fixo

Mais uma opção interessante no servidor DHCP é a possibilidade de relacionar um determinado endereço IP com o endereço MAC de certo micro da rede. Isso faz com que ele sempre obtenha o mesmo endereço a partir do servidor DHCP, como se tivesse sido configurado para usar IP fixo.

Esse recurso é usado, por exemplo, em uma pequena rede, onde alguns micros compartilham impressoras e arquivos e por isso não podem ficar mudando de endereço IP a cada reboot. Configurar o servidor DHCP para dar a eles sempre o mesmo IP pode ser mais prático que configurá-los para usar IP fixo manualmente, pois eles continuarão recebendo o mesmo IP mesmo que você reinstale o sistema (pois, apesar da mudança de sistema operacional, a placa de rede continuará a mesma).

Para usar este recurso, adicione uma seção, como mostrada abaixo, para cada host no final do arquivo dhcpd.conf, depois de todas as linhas de configuração, mas antes de fechar a chave ( } ):

host m5 {

hardware ethernet 00:0F:B0:55:EA:13;

fixed-address 192.168.1.211;

}

ddns-update-style none;

default-lease-time 600;

max-lease-time 7200;

authoritative;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.100 192.168.1.199;

option routers 192.168.1.1;

option domain-name-servers 208.67.222.222,208.67.220.220;

option broadcast-address 192.168.1.255;

host m5 {

hardware ethernet 00:0F:B0:55:EA:13;

fixed-address 192.168.1.211;

}

host windows {

hardware ethernet 00:0F:B0:45:BC:17;

fixed-address 192.168.1.212;

}

}

Não se esqueça de reiniciar o servidor DHCP depois de configurar o arquivo para que a nova configuração seja aplicada!

Uma pergunta recorrente sobre o uso de servidores DHCP é sobre a possibilidade de manter mais de um servidor DHCP ativo.

Entretanto, em algumas situações, uma configuração com dois servidores DHCP pode funcionar, naturalmente depois de bem testada.

O dhcp3-server usado no Linux é bastante rápido, por isso (desde que a configuração não seja muito complexa) costuma responder antes dos servidores DHCP usados nos servidores Windows e na maioria dos roteadores wireless, o que, dependendo da situação, pode ser usado a seu favor.

A T I V I D A D E D E A P R E N D I Z A G E M

1 – Continuando as configurações no nosso ambiente virtual de testes, instale e configure o serviço de DHCP no servidor Linux e teste seu funcionamento no cliente Windows seguindo as etapas aprendidas nessa aula.

2 – Configure o serviço de DHCP para fornecer sempre o mesmo endereço IP, igual a 192.168.1.215, para o cliente Windows.

Meta:

Apresentar os principais conceitos referentes ao serviço de Proxy.

Objetivo: Ao final desta aula você deverá ser capaz de:

Compreender os principais conceitos relacionados ao serviço de Proxy;

4.1. Introdução

Em redes de computadores, um proxy é um servidor que age como um intermediário para requisições de clientes que solicitam recursos de outros servidores. Um cliente conecta-se ao servidor proxy, solicitando algum serviço, como uma página web por exemplo. O proxy então avalia a solicitação como um meio de simplificar e controlar sua complexidade.

O servidor proxy surgiu da necessidade de conectar uma rede local à Internet através de um computador da rede que compartilha a sua conexão com as demais máquinas. Ou seja, se considerarmos que a rede local é uma rede "interna" e a Internet uma rede "externa", podemos dizer que o proxy é aquele que permite que as maquinas da rede interna tenham acesso a rede externa.

Geralmente, as máquinas da rede interna não possuem endereços válidos na Internet e, portanto, não têm uma conexão direta com a mesma. Assim, toda a solicitação de conexão de uma máquina da rede local para uma máquina da Internet é direcionada ao proxy; este, por sua vez, realiza o contato com máquina desejada, repassando a resposta da solicitação para a máquina da rede local. Por este motivo, é utilizado o termo proxy para este tipo de serviço, que, em Informática, é geralmente traduzido como intermediário. Existem diversos softwares de proxy disponíveis, podemos citar como exemplo o Wingate e o Squid.

4.2. Usos de um servidor proxy

repassa as requisições recebidas, como um garoto de recados. O proxy é como um burocrata que não se limita a repassar as requisições: ele analisa todo o tráfego de dados, separando o que pode ou não pode passar e guardando informações para uso posterior.

Compartilhar a conexão via NAT é mais simples do que usar um proxy sob vários aspectos. Você compartilha a conexão no servidor, configura os clientes para utilizarem esse servidor como gateway e pronto. Ao usar um proxy, além da configuração da rede, é necessário configurar o navegador e cada outro programa que for acessar a Internet (em cada um dos clientes da rede) para usar o proxy. Esta é uma tarefa tediosa e que acaba aumentando bastante seu volume de trabalho, pois toda vez que um micro novo for colocado na rede ou for preciso reinstalar o sistema, será preciso fazer a configuração novamente.

A configuração do proxy muda de navegador para navegador. No Firefox, por exemplo, você a encontra em "Opções > Avançado > Rede > Configurar conexão", conforme mostrado na Figura 4.1.

Figura 4.1 – Configurando o Firefox para utilizar o proxy

Também conhecido como

proxy de interceptação, proxy inline ou proxy forçado, o

proxy transparente intercepta uma

comunicação normal na camada de rede

sem necessitar de qualquer configuração específica no cliente. Os clientes não precisam estar

cientes da existência do

Além do navegador, outros programas podem ser configurados para trabalhar através do proxy, como o Skype e programas P2P. As vantagens de usar um proxy são basicamente três:

1 - É possível impor restrições de acesso com base no horário, login, endereço IP da máquina e outras informações, além de bloquear páginas com conteúdo indesejado.

2 - O proxy funciona como um cache de páginas e arquivos, armazenando informações já acessadas. Quando alguém acessa uma página que já foi carregada, o proxy envia os dados que guardou no cache, sem precisar acessar a mesma página repetidamente. Isso acaba economizando bastante banda, tornando o acesso mais rápido.

Dependendo da configuração, o proxy pode apenas acelerar o acesso às páginas ou servir como um verdadeiro cache de arquivos, armazenando atualizações do Windows Update, downloads diversos e pacotes instalados através do apt-get, por exemplo. Em vez de ter que baixar o último Service Pack do Windows ou a última atualização do Firefox nos 10 micros da rede, você vai precisar baixar apenas no primeiro, pois os outros 9 vão baixar a partir do cache do proxy.

3 - Uma terceira vantagem de usar um proxy é que ele loga todos os acessos realizados através dele. Você pode visualizar os acessos posteriormente usando um gerador de relatórios que transforma as longas listas de acessos dos logs em arquivos html bem organizados.

Figura 4.2 –Layout da rede de testes com a utilização do proxy

4.3. Configurando um servidor proxy com o Squid

O Squid é composto de um único pacote, por isso a instalação é simples. No Ubuntu, podemos instalar o pacote "squid" usando o apt-get, como usuário root, conforme mostrado no comando abaixo:

# apt-get install squid

Toda a configuração do Squid é feita em um único arquivo, o "/etc/squid/squid.conf". Apesar da mudança na localização do arquivo de configuração nas demais distribuições disponíveis, as opções descritas aqui vão funcionar em todas elas sem maiores problemas.

O arquivo original, instalado junto com o pacote, é realmente enorme, contém comentários e exemplos para quase todas as opções disponíveis. Ele pode ser uma leitura interessante se você já tem uma boa familiaridade com o Squid e quer aprender mais sobre cada opção, mas, de início, é melhor começar com um arquivo de configuração mais simples, apenas com as opções mais usadas.

Comece renomeando o arquivo padrão, de forma a conservá-lo para fins de pesquisa, conforme o exemplo abaixo:

Em seguida, crie um novo arquivo squid.conf, no mesmo local (/etc/squid), contendo apenas as quatro linhas abaixo:

http_port 3128

visible_hostname ubuntu

acl all src 0.0.0.0/0.0.0.0

http_access allow all

Estas linhas são o suficiente para que o Squid "funcione". Aquele arquivo de configuração gigante tem mais uma função informativa, citando e explicando as centenas de opções disponíveis. Apenas um punhado das opções são realmente necessárias, pois, ao omiti-las, o Squid simplesmente utiliza os valores padrões. É por isso que acaba sendo mais simples começar com um arquivo vazio e ir inserindo apenas as opções que você conhece e deseja alterar.

As quatro linhas dizem o seguinte:

http_port 3128: A porta onde o servidor Squid vai ficar disponível. A porta 3128 é o padrão, mas muitos administradores preferem utilizar a porta 8080, que soa mais familiar a muitos usuários.

visible_hostname ubuntu: O nome do servidor, o mesmo que foi definido na configuração da rede. Portanto, não se esqueça de substituir o "ubuntu" pelo nome correto do seu servidor, como informado pelo comando "hostname".

acl all src 0.0.0.0/0.0.0.0 e http_access allow all: Estas duas linhas criam uma acl (uma política de acesso) chamada "all" (todos), incluindo todos os endereços IP possíveis. Ela permite que qualquer um dentro desta lista use o proxy, ou seja, permite que qualquer um use o proxy, sem limitações.

comando:

# service squid restart

Para testar o proxy, configure um navegador (no próprio servidor) para usar o proxy, através do endereço 127.0.0.1 (o localhost), porta 3128. Se tudo estiver funcionando, você conseguirá acessar o proxy também através do cliente Windows da rede local, basta configurar o navegador para usar o proxy, fornecendo o endereço do servidor Linux na rede local.

4.4. Criando uma configuração básica

O problema com o modelo de configuração minimalista que acabamos de ver é que com apenas estas quatro linhas o proxy ficará muito aberto. Se você deixar o servidor proxy ativo no próprio servidor que compartilha a conexão, como é o caso do nosso exemplo, e não houver nenhum firewall ativo, qualquer um na internet poderia usar o seu proxy, o que naturalmente não é desejado. O proxy deve ficar ativo apenas para a rede local.

Vamos gerar, então, um arquivo mais completo, permitindo que apenas os micros da rede local possam usar o proxy e definindo mais algumas políticas de segurança. Neste segundo exemplo foram aproveitadas algumas linhas do arquivo original, criando regras que permitem o acesso a apenas algumas portas específicas e não mais a qualquer coisa, como na configuração anterior.

As acl's "SSL_ports" e a "Safe_ports" são as responsáveis por limitar as portas que podem ser usadas através do proxy. Conforme você verá a seguir, neste exemplo foi usado a configuração-modelo indicada na documentação do Squid, que prevê o uso de diversos protocolos conhecidos e também o uso de portas altas, acima da 1024.

Em geral, cada distribuição Linux

inclui uma ferramenta diferente para a configuração do

proxy. Uma das

mais usadas é o Webmin, disponível em

várias distribuições. A

função dessas ferramentas é disponibilizar as opções através de

uma interface gráfica e gerar o

arquivo de configuração com

http_port 3128

visible_hostname gdh

acl all src 0.0.0.0/0.0.0.0

acl localhost src 127.0.0.1/255.255.255.255 acl SSL_ports port 443 563

acl Safe_ports port 21 80 443 563 70 210 280 488 59 777 901 1025-65535

acl CONNECT method CONNECT

http_access deny !Safe_ports

http_access deny CONNECT !SSL_ports

acl redelocal src 192.168.1.0/24 http_access allow localhost http_access allow redelocal

http_access deny all

A acl "localhost" contém o endereço 127.0.0.1, que utilizamos ao usar o proxy localmente (ao navegar usando o próprio servidor), e a acl "rede local", que inclui os demais micros da rede local. Caso esteja utilizando uma faixa de endereços diferente do exemplo, substitua o "192.168.1.0/24" pela faixa de endereços IP e a máscara de sub-rede usada na sua rede local (o 24 equivale a mascara 255.255.255.0).

Depois de criadas as duas políticas de acesso, vão duas linhas no final do arquivo que especificam que os micros que se enquadrarem nelas poderão usar o proxy:

http_access allow localhost

http_access allow redelocal

Lembra-se da acl "all", que contém todo mundo? Vamos usá-la para especificar que os clientes que não se enquadrarem nas duas regras acima (ou seja, clientes não-autorizados, vindos da Internet) não poderão usar o proxy:

Esta linha deve fica no final do arquivo, depois das outras duas. A ordem é importante, pois o Squid interpreta as regras na ordem em que são colocadas no arquivo. Se você permite que o micro X acesse o proxy, ele acessa, mesmo que uma regra mais abaixo diga que não. Por exemplo, se você adicionasse algo como:

acl redelocal src 192.168.1.0/24

http_access allow redelocal

http_access deny redelocal

... os micros da rede local continuariam acessando, pois a regra que permite vem antes da que proíbe.

Depois de configurar o arquivo, não se esqueça de reiniciar o serviço para que a configuração entre em vigor. Nesse ponto o seu proxy já está completamente funcional.

4.5. Adicionando restrições de acesso

Em um ambiente de trabalho ou escolar, a idéia é que a Internet seja usada para comunicação, pesquisa e outras funções relacionadas ao que estão fazendo. Muitas instituições permitem que sejam acessados os e-mails pessoais e coisas do gênero, mas sempre até um certo limite. Seu chefe não gostaria se você começasse a passar a maior parte do tempo no Facebook, por exemplo. Chegamos então às regras para restrição de acesso, que são uma necessidade em muitas redes.

4.5.1. Bloqueando por domínios

feito em duas etapas. Primeiro você cria a acl, especificando os endereços e, em seguida, usa o parâmetro "http_access" para bloquear o acesso a eles. Veja um exemplo:

acl bloqueados dstdomain facebook.com http_access deny bloqueados

Foi criada uma acl chamada "bloqueados", que contém o endereço "facebook.com" e em seguida usado o parâmetro "http_access deny" para bloquear o acesso a ele. Você pode incluir diversas acls diferentes dentro da configuração do Squid, desde que use um nome diferente para cada uma. De certa forma, elas são similares às variáveis, que usamos ao programar em qualquer linguagem.

Ao aplicar a regra, o Squid faz a resolução do domínio e passa a bloquear todas sub-páginas que estiverem hospedadas dentro dele. Contudo, existe uma ressalva, muitos sites podem ser acessados tanto com o "www" quanto sem. Se os dois estiverem hospedados em servidores diferentes, o Squid considerará que tratam-se de dois sites diferentes, de forma que ao bloquear apenas o "www.facebook.com" os usuários ainda conseguirão acessar o site através do "facebook.com" e vice-versa. Nesses casos, para bloquear ambos, é preciso incluir as duas possibilidades dentro da regra, como em:

acl bloqueados dstdomain facebook.com www.facebook.com

http_access deny bloqueados

Você pode incluir quantos domínios quiser dentro da acl, basta separá-los por espaço e deixar tudo na mesma linha.

IP, o que é útil em casos de servidores sem domínio registrado, ou que respondam por vários domínios. Nesse caso, a regra ficaria:

acl ips-bloqueados dst 200.234.21.23 200.212.15.45

http_access deny ips-bloqueados

Você pode descobrir rapidamente o endereço IP de um determinado domínio usando o comando "host", como em:

$ host google.com

google.com A 72.14.207.99 google.com A 64.233.187.99 google.com A 64.233.167.99

As regras de bloqueio devem vir antes do "http_access allow redelocal", que abre tudo para a rede local. Como o Squid processa as regras sequencialmente, as páginas que forem bloqueadas pela acl "bloqueados" não chegam a passar pela regra que autoriza os acessos provenientes da rede local.

Por padrão, as mensagens de erro aparecem em inglês. Para colocá-las em português, basta adicionar no arquivo de configuração do Squid a linha "error_directory /usr/share/squid/errors/pt-br".

É possível personalizar as páginas de erro editando os arquivos dentro da pasta. Ela contêm várias páginas html, uma para cada tipo de erro indicado.

4.5.2. Bloqueando por horário

Podemos fazer com que o proxy aceite ou recuse conexões feitas dentro de determinados horários. Você pode definir regras para períodos específicos e combiná-las para bloquear todos os horários em que você não quer que o proxy seja usado ou vice-versa. Para que o proxy bloqueie acessos feitos entre meia-noite e 6:00 da manhã e no horário de almoço, por exemplo, usaríamos as regras:

acl madrugada time 00:00-06:00 http_access deny madrugada

acl almoco time 12:00-14:00 http_access deny almoco

Estas regras iriam, novamente, antes da regra "http_access allow redelocal" no arquivo de configuração.

Agora, imagine que você quer fazer diferente. Ao invés de bloquear o acesso na hora de almoço, você quer deixar o proxy aberto, para que aqueles que queiram acessar o facebook possam fazer isso fora do horário de trabalho. Neste caso, você usaria uma regra como:

acl almoco time 12:00-14:00 http_access allow almoco

fazem o bloqueio,

Você pode também combinar o bloqueio de palavras ou domínio com as regras de bloqueio por horário, permitindo que os usuários acessem um determinado site apenas no horário de almoço, por exemplo. Neste caso, a regra seria:

acl almoco time 12:00-14:00

acl face dstdomain facebook.com www.facebook.com http_access allow face almoco

http_access deny face

Fazendo isso, o Squid entende que os endereços incluídos dentro da acl "face" devem ser permitidos, mas apenas dentro do horário especificado na acl "almoco". Em seguida é incluída mais uma regra, que bloqueia o acesso ao site em outros horários.

Concluindo, existem diversos recursos e opções de configurações disponível no Squid, por motivos de espaço apresentamos apenas as mais utilizadas. Caso você esteja interessado em saber mais sobre o proxy Squid e suas possibilidade de configuração, sugerimos o conteúdo disponível em: http://www.hardware.com.br/livros/servidores-linux/configurando-servidor-proxy-com-squid.html

A T I V I D A D E D E A P R E N D I Z A G E M

1 – Usando o ambiente de testes virtual, instale e configure o Proxy Squid no servidor Linux.

2 – Crie duas regras de bloqueio, uma por domínio e outra por horário.

Meta:

Apresentar os principais conceitos relacionados aos servidores Windows.

Objetivo: Ao final desta aula você deverá ser capaz de:

Conhecer as principais características dos servidores Windows;

5.1 – Introdução

Nas aulas anteriores, estudamos sobre a configuração de servidores Linux, incluindo a configuração de servidores DHCP, Proxy, além de compartilharmos a conexão com à Internet. Vamos agora estudar também um pouco sobre como as coisas funcionam no mundo dos servidores Windows.

O objetivo desta aula é servir como uma introdução à configuração do Windows Server, mostrando os principais recursos do sistema e os passos básicos para configurá-lo. A idéia não é transformá-lo em um especialista em redes Windows, mas sim oferecer um resumo das opções disponíveis.

Para realizar os estudos propostos nessa aula, iremos utilizar o Windows 2003 Server. O motivo de escolher essa versão do sistema é o mesmo das aulas anteriores, utilizar máquinas virtuais e poder realizar os testes mesmo em computadores com poucos recursos disponíveis. Dessa forma, mesmo que você não possua um computador com muita memória disponível, ou com um processador atual, poderá simular o ambiente de testes proposto nessa aula!

É importante enfatizar que mesmo sendo uma versão antiga do sistema operacional para servidores da Microsoft, e possuindo sucessores como Windows 2008 Server e o Windows Server 2012, o Windows 2003 Server ainda continuará sendo usado durante muitos anos, pois o ritmo de atualização nos servidores é muito mais lento do que nos desktops, já que o investimento necessário para atualizar os servidores (incluindo máquinas, mão de obra e outros custos relacionados) é maior e temos também o risco de algo dar errado durante a migração, causando interrupção nos serviços de rede e causando prejuízos.