La deuxième partie de ce manuscrit porte sur la présentation et la validation des prédictions du modèle discret de prédiction de la couverture radio. Comme présenté en introduction, le problème de la conception d'un réseau local sans fil se pose dans le mode de fonctionnement infrastructure.

![Fig. 1 – Catégories de réseaux sans-fil. (Source [1])](https://thumb-eu.123doks.com/thumbv2/1bibliocom/459832.66856/9.892.237.610.594.805/fig-catégories-réseaux-fil-source.webp)

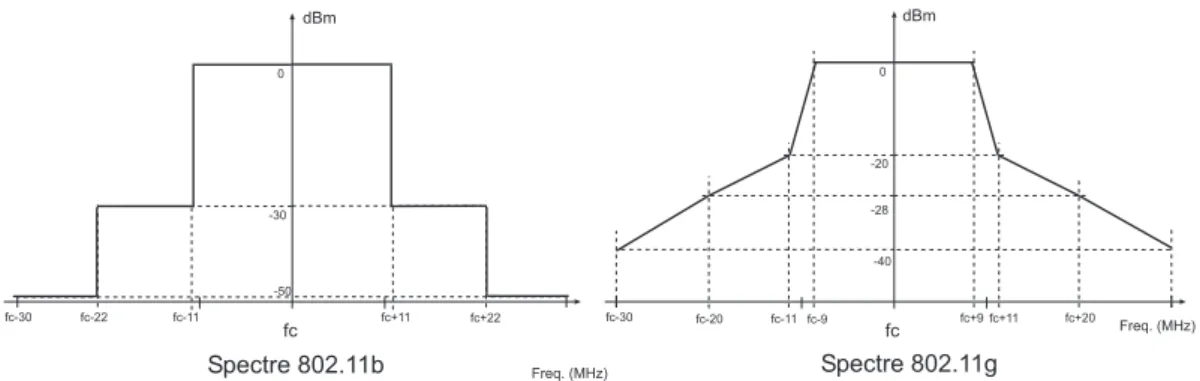

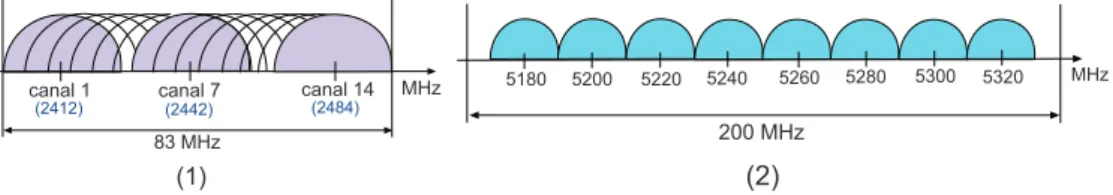

Le standard IEEE 802.11

- Les normes

- Les couches physiques 802.11

- La couche MAC 802.11

- Le déploiement de réseaux sans-fil

Cette détection de collision est à la base de la technique d'accès CSMA/CD (Collision Detection). PIFS (Inter-Frame Spacing Coordination Point) : cette durée est utilisée pour envoyer un paquet en mode d'accès PCF.

Variables et paramètres du problème wLP

Le nombre de points d’accès N

La position des AP

Avec l'augmentation de la surface à planifier, la formulation discrète des positions s'est avérée beaucoup plus abordable pour deux raisons. On peut alors considérer qu'un point d'accès présent au centre d'un espace est représentatif des autres positions candidates dans l'espace, passant ainsi d'un espace continu de positions à un espace discret.

Les paramètres antennaires

Modifier la position p = (px, py) d'un point d'accès permet de pallier ce manque de paramètres d'antenne. 35] recherche à la fois la position et la puissance d'émission du nombre minimum de points d'accès.

Les objectifs de la planification

- Notations

- Les objectifs de couverture radio

- Les objectifs de recouvrement et d’interférences

- Les objectifs de trafic et de qualité de service

- Résumé

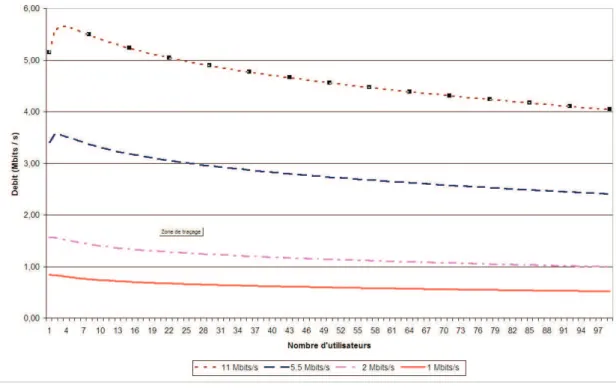

- Modélisation du comportement du réseau

Ce critère calcule la valeur moyenne des actifs absents des lacunes de couverture. 1.13 – Evolution de la zone d'interférence d'un PA par simulation, en fonction de l'équipement actif.

Les formulations du problème wLP

- Formulations génériques

- Modèles utilisés

- Le canal radio Indoor

- Les approximations circulaires

- Les modèles empiriques

- Les modèles déterministes

- Résumé et Perspectives

De ce fait, il n'est plus possible de modéliser la propagation des ondes par une simple fonction de la distance entre émetteur et récepteur. En résumé, la complexité de la technique d'imagerie peut être approchée par Nr nrw où nw est le nombre d'objets et r le nombre de réflexions (ou diffractions) successives autorisées.

Algorithmes d’optimisation pour le problème wLP

La difficulté du problème wLP

Cf : le nombre d'opérations élémentaires nécessaires pour évaluer la solution, - la nature de la fonction d'évaluation. Le déplacement du point d'accès d'une pièce à une autre du bâtiment entraîne l'interruption de la fonction d'évaluation.

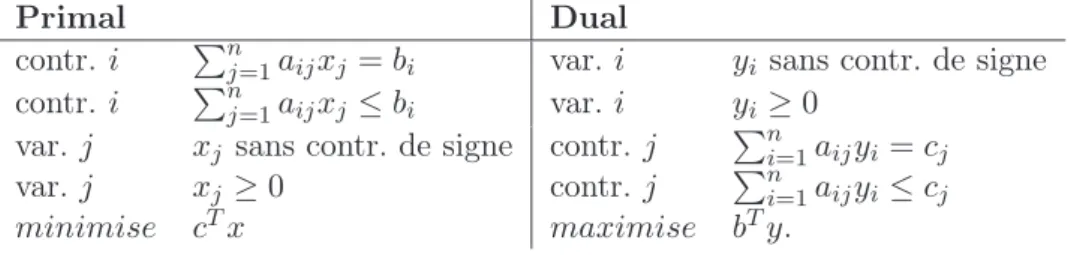

L’optimisation mono-objectif continue

Cette méthode itérative recherche le minimum de la fonction d'évaluation dans une seule direction de l'espace des solutions. La méthode des gradients conjugués permet de s'affranchir du problème de convergence de la descente des gradients. C'est dans le choix de la nouvelle direction de recherche que les deux méthodes diffèrent.

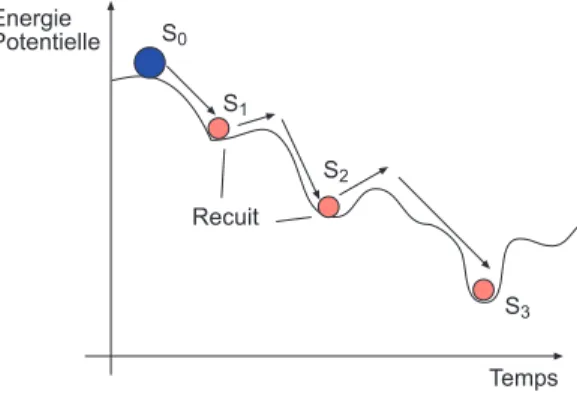

L’optimisation mono-objectif combinatoire

Le but de la première étape est de trouver une solution réalisable au problème qui soit également un optimum local. De cette manière, la taille de l'espace de recherche est réduite car la recherche est interdite dans le sens défini par la variable tabou. Une solution voisine de la solution s est obtenue en changeant la valeur d'une seule de ses variables.

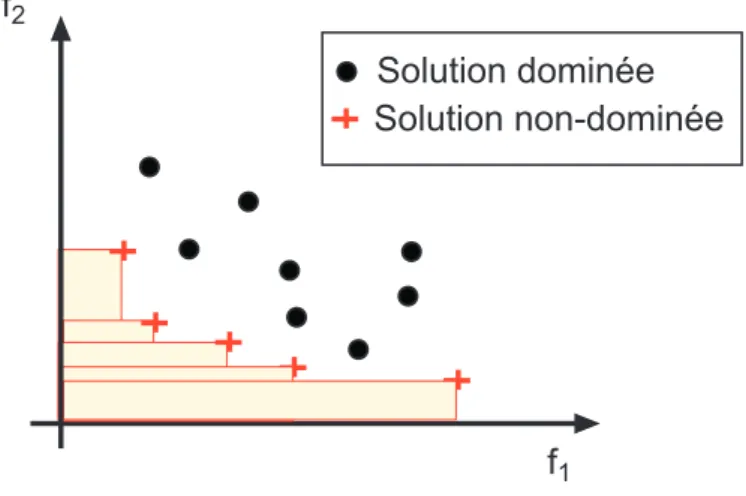

L’optimisation multiobjectif

Une recherche classique de l'algorithme de recuit se fait selon une fonction totale de la forme. La deuxième famille d'algorithmes exploite une population de solutions qui évoluent en parallèle au cours de la recherche. Toutes les solutions de la population se voient donc attribuer un rang r(i) au sens de Pareto.

Conclusions et perspectives

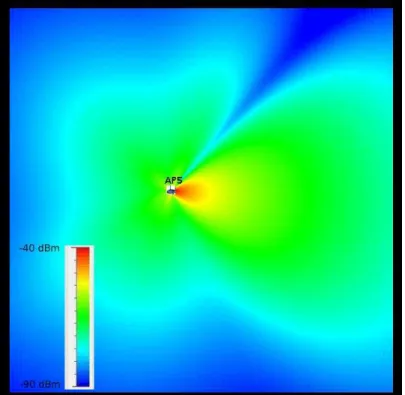

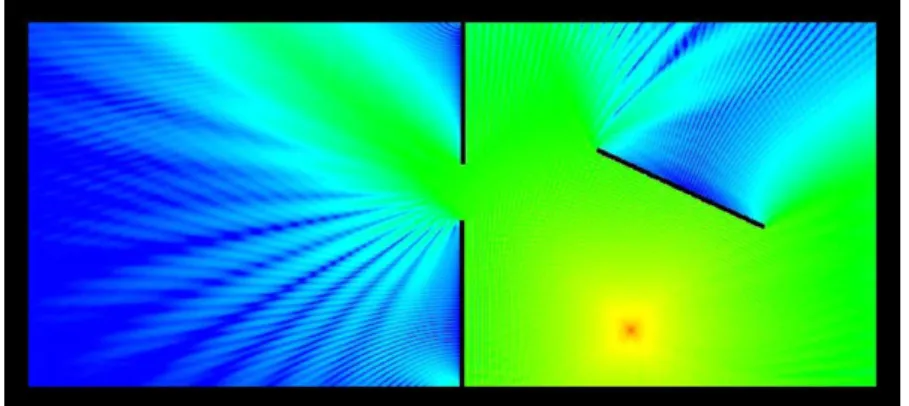

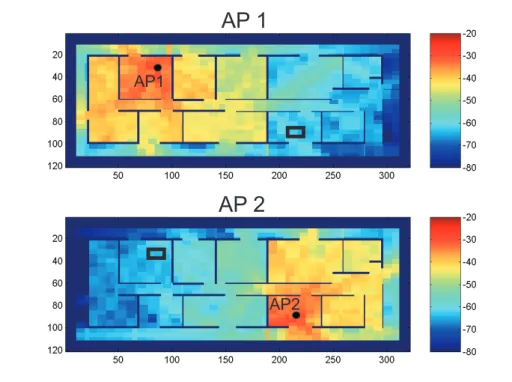

Les conclusions établies dans l'état de l'art (voir chapitre 2.3) montrent que la difficulté de choisir une méthode de calcul de multiplication réside dans le compromis entre fiabilité et temps de calcul qui doit être établi. Dans ce travail de thèse, nous avons adapté l'algorithme MR-FDPF pour estimer la couverture radio des émetteurs de type 802.11b dans des environnements fermés (ou intérieurs) bidimensionnels. La dernière sous-section 3.1.6 présente les cartes de couverture actuellement obtenues et les performances de la méthode en termes de temps de calcul et de consommation mémoire.

Développements théoriques

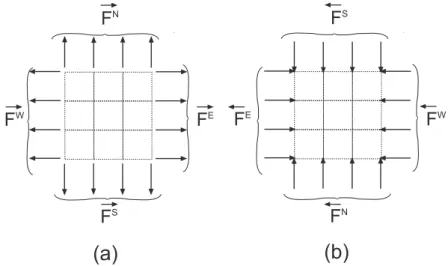

- L’algorithme temporel ParFlow

- L’algorithme ParFlow dans le domaine fréquentiel (FDPF)

- La modélisation par blocs

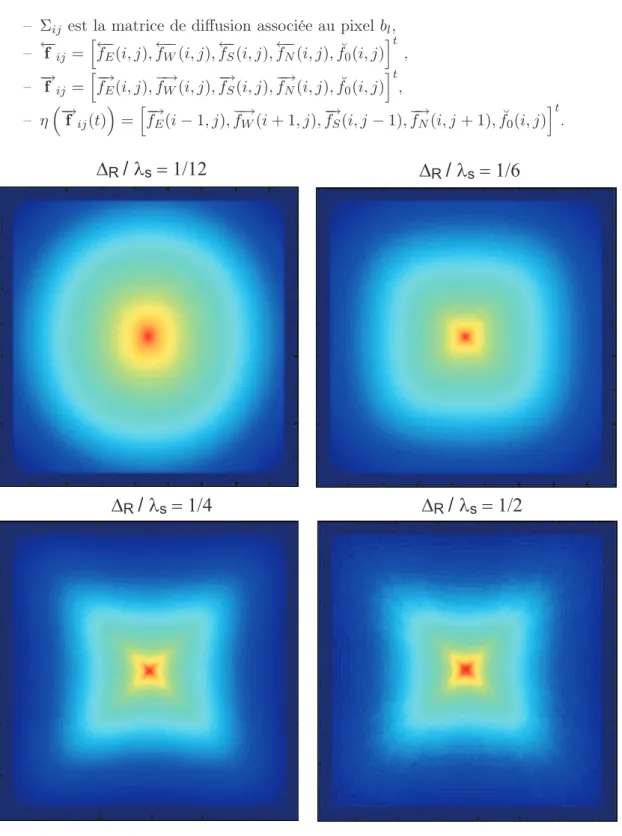

- L’approche multi-résolution

- Découpage adaptatif de l’environnement

- Implantation et performances

Nous verrons qu'une telle structure est très efficace pour calculer la propagation. Le calcul de la matrice de diffusion de ces blocs est long et augmente donc la durée de l'étape de prétraitement. Pour obtenir ces cartes, la phase de descente de la pyramide a été arrêtée : – (a) au niveau de blocs homogènes.

Mise en oeuvre pour les réseaux sans fil

L’approximation 2D / 3D

Choix de la résolution ∆ R

Pour que cette simulation ait un sens, il faut pouvoir moyenner le champ sur des blocs de taille Rcouv x Rcouv. Enfin, pour que ce moyennage permette de s'affranchir de petites variations locales, le moyennage doit être effectué sur une distance supérieure ou égale à la longueur d'onde, c'est-à-dire Rcouv > λs. Pour obtenir une estimation de l'effet moyen à une résolution de 1m, on peut travailler sur des blocs de taille 10×10 pixels.

Les paramètres des matériaux

La condition sur la puissance moyenne est respectée et la taille des pixels est donnée par . Ainsi, pour une distance unitaire fixe ∆R, la valeur du facteur d'atténuation est donnée par α =e-a ∆R. Comme on peut le voir sur ces données, le choix d'une valeur théorique d'indice et de coefficient d'amortissement n'est pas aisé.

Le processus de calibration

Par conséquent, la solution∗ n'est optimale que pour l'environnement de test où les mesures ont été effectuées. La recherche exhaustive d'un jeu de paramètres n'est pas envisageable compte tenu du nombre de variables. Le critère d'optimisation n'est pas une fonction analytique des paramètres des matériaux, et il n'est pas possible de déterminer analytiquement si la fonction d'évaluation est mono- ou multimodale.

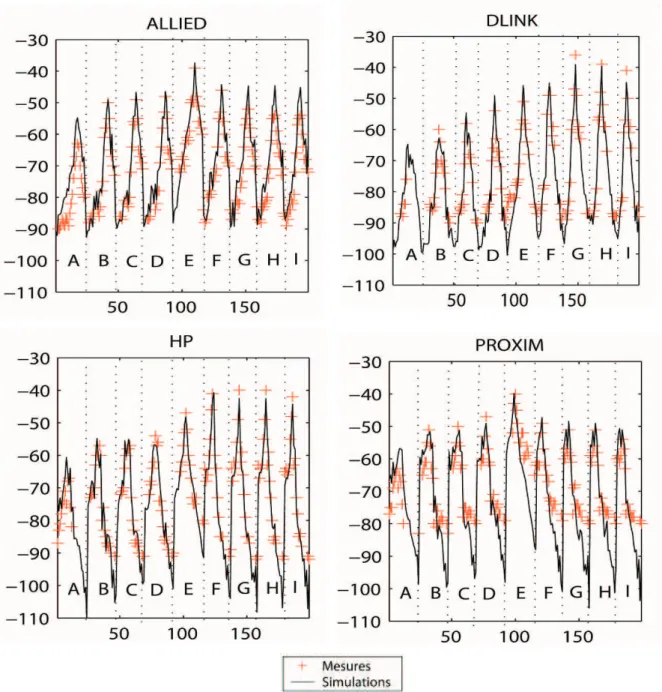

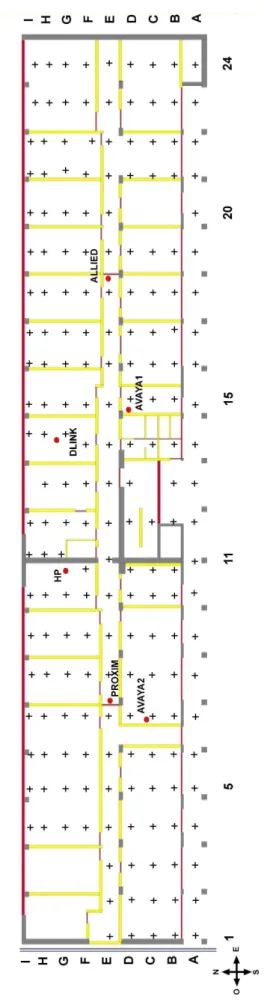

Environnements de test et protocole de mesures

Les résultats ont été obtenus en calculant le critère f sur une grille régulière de points test. À l'exception des cas à la limite de couverture, la distribution était assez proche d'une distribution normale. Pour valider les résultats d'étalonnage obtenus avec les données CITI1, un environnement de test différent a été utilisé.

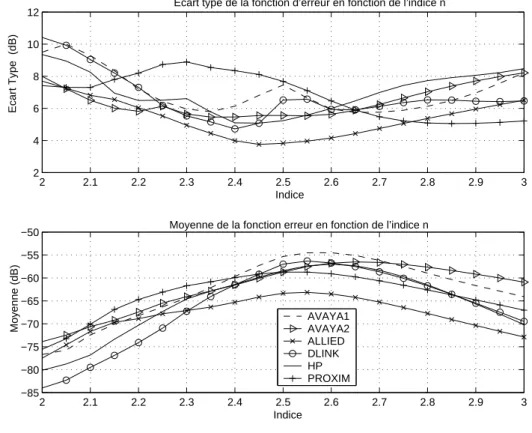

Modélisation à un matériau

Le graphique 4.5 montre sur la courbe l'évolution de l'écart-type moyen σavg en fonction de l'indice. Evolution de l'écart type en fonction de l'indice matière et du coefficient d'absorption d'air. Fig.4.9 – Évolution de l'écart type en fonction de l'indice et du coefficient d'affaiblissement à l'air.

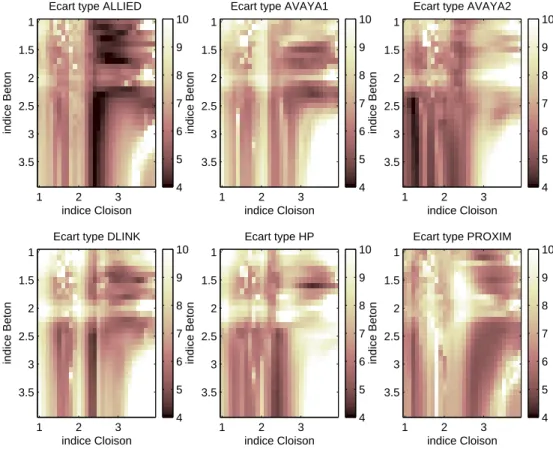

Modélisation à deux matériaux

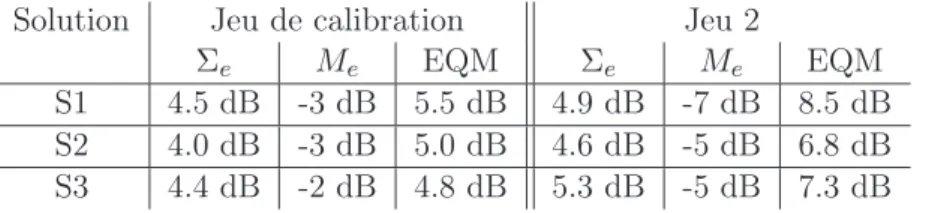

La figure 4.11 donne la distribution de l'écart-type σe dans le réseau d'indices pour chaque ensemble de mesures. Si l'on observe les chiffres représentant l'erreur pour chaque ensemble de mesures (fig. 4.11), on remarque que la détermination de l'indice de division se fait facilement. Le tableau 4.7 présente la moyenne sur les 6 groupes de test des erreurs quadratiques moyennes, des écarts-types et de l'espérance de la fonction d'erreur de prédiction calculée avec les 6 solutions obtenues.

Synthèse

Mise en oeuvre de DIRECT

- Modélisation à un matériau

- Modélisation à deux matériaux

- Modélisation à trois matériaux

- Conclusion

On note que pour le critère à 6 AP, la valeur de l'indice béton est plus proche de 4,0 que de 3,9. Ce phénomène est illustré par le graphique 4.15 qui montre l'évolution du critère en fonction de l'indice du béton lorsque l'indice des cloisons est fixé à 2,4. La solution minimale fournit une efficacité de 5,3 dB pour les 6 instances, ce qui est bien meilleur.

Résultats et conclusions

Mode de validation

Tab.4.15 – Écart type, moyenne et EQM des erreurs de prédiction avec S1, S2 et S3 pour le deuxième ensemble de tests CITI. Pour chaque solution, la moyenne Me, l'écart type Σe et l'EQM des erreurs de prédiction ont été calculés. Tab.4.16 – Écart type, moyenne et EQM des erreurs de prédiction avec S1, S2 et S3 pour l'ensemble de test BuildingG.

Analyse

Le jeu de tests d'étalonnage comporte 175 points de mesure et l'autre jeu en compte 15. Pour la solution S1, une diminution de 4 dB est observée pour le deuxième jeu de tests. On observe que les erreurs quadratiques moyennes sont du même ordre de grandeur que les MSE obtenues avec les jeux de tests d'étalonnage.

Conclusions

Par contre, comme l'étalonnage du déplacement n'est que très rapide car il ne nécessite pas de recalcul de la pyramide, il est probablement intéressant d'effectuer systématiquement pour un nouvel environnement, l'ajustement du déplacement par étalonnage, quitte à conserver les indices matériaux standards . C'est cette calibration minimale qui a été introduite en standard dans la version logicielle de WILDE.

Stratégies de planification wLAN 146

Placement des points d’accès candidats

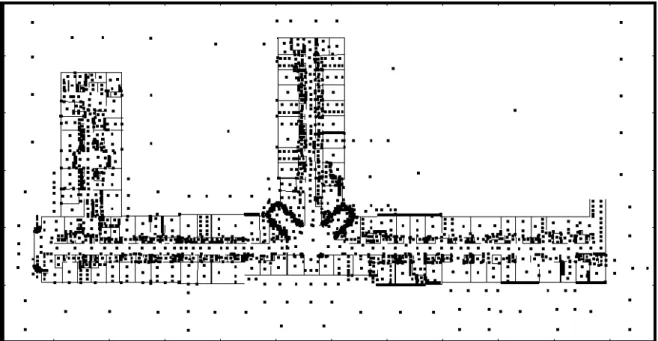

Ainsi, nous plaçons M points d'accès candidats du processus de planification au centre de blocs homogènes définis dans la pyramide MR-FDPF. La figure 5.1, appelée Foch, décrit la répartition des positions AP candidates placées au centre de tous les blocs homogènes de la pyramide MR-FDPF. Afin d'éviter la redondance de points d'accès candidats similaires, la taille des blocs homogènes sélectionnés pour le placement des points d'accès doit être limitée par la zone Amin minimale.

Paramètres antennaires

Cartes de couverture

La liste des blocs à couvrir indique tous les blocs homogènes présents dans les zones QoS. Ces blocs homogènes sont sélectionnés selon le même processus que ceux de la liste des blocs candidats. Pour l'environnement illustré à la Figure 5.3, le temps de traitement pour obtenir une carte de couverture avec la résolution de blocs homogènes sur l'ensemble de l'environnement est de 1,1 seconde.

Représentation matricielle

Ainsi, le calcul des critères d'ordonnancement ne se fait que sur ces zones de QoS. Avec la méthode MR-FDPF, la couverture des AP candidats n'est estimée que pour l'ensemble des blocs homogènes appartenant à ces zones de QoS. En réduisant la zone de desserte au bâtiment unique et en limitant la surface de blocs homogènes entre Amin=600pixels2 et Amax=8000pixels2, le temps de calcul d'une carte de couverture est réduit à 700 millisecondes.

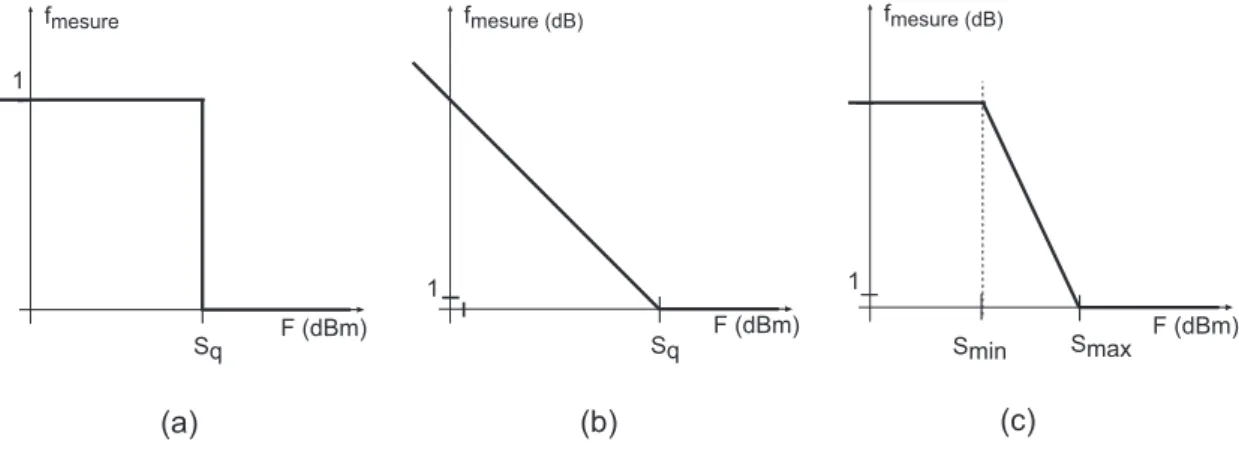

Critères de planification

- Critères de couverture

- Critères d’interférences

- Critère de débit

- Critère de localisation

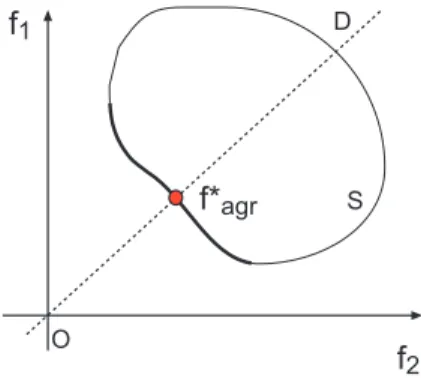

- Fonction de coût agrégée

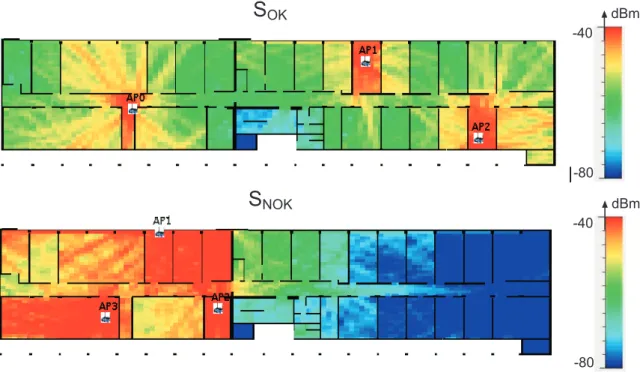

Ensuite, le critère de recouvrement est défini par l'équation 5.5 et la fonction de mesure présentée ci-dessus. Fig.5.7 – La carte de couverture des solutions SOK et SN OK avec le critère de couverture pour h= 2 et N = 7. C'est le critère de couverture qui lors de la recherche limite le nombre de signaux dans un bloc à h.

Algorithmes mono-objectifs

- Heuristique déterministe

- Métaheuristique tabou

- Résultats de planification avec la recherche mono-objectif tabou

La Figure 6.4-(a) montre la carte de couverture de la meilleure solution de recherche combinatoire. La taille du voisinage que nous avons défini évolue en fonction de la taille de l'espace des solutions et des paramètres considérés dans la recherche. Si une solution de voisinage modifie un AP dans la liste, la solution est tabou.

Algorithme multiobjectif

- Heuristique multiobjectif tabou

- Résultats de la recherche multiobjectifs

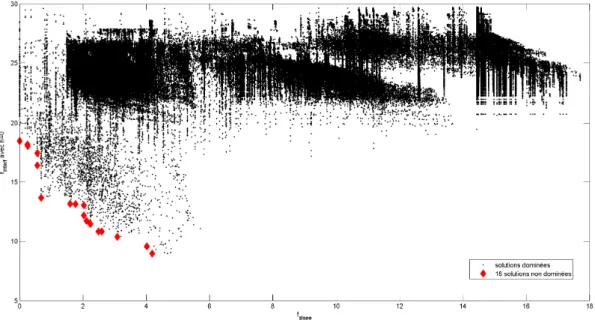

La taille du front de Pareto que l'on obtient en fin de recherche est bien supérieure au nombre de solutions que l'on veut obtenir pour la sélection a posteriori. Néanmoins, il pourrait être utilisé pour sélectionner les solutions du front de recherche actuel FP P(i). Le nombre de solutions du front actuel a été fixé à K = 18 et le rang de Pareto maximal à R = 2.

Conclusions